Einbettungen

Leistungsstarke multimodale, mehrsprachige Langkontext-Einbettungen für Such-, RAG- und Agentenanwendungen.

Einbettungs-API

Probieren Sie unsere erstklassigen Einbettungsmodelle aus, um Ihre Such- und RAG-Systeme zu verbessern. Beginnen Sie mit einer kostenlosen Testversion!

chevron_leftchevron_right

Beispieleingaben

Ändern Sie sie und sehen Sie, wie sich die Reaktion ändert!

Organic skincare for sensitive skin with aloe vera and chamomile: Imagine the soothing embrace of nature with our organic skincare range, crafted specifically for sensitive skin. Infused with the calming properties of aloe vera and chamomile, each product provides gentle nourishment and protection. Say goodbye to irritation and hello to a glowing, healthy complexion. |

Bio-Hautpflege für empfindliche Haut mit Aloe Vera und Kamille: Erleben Sie die wohltuende Wirkung unserer Bio-Hautpflege, speziell für empfindliche Haut entwickelt. Mit den beruhigenden Eigenschaften von Aloe Vera und Kamille pflegen und schützen unsere Produkte Ihre Haut auf natürliche Weise. Verabschieden Sie sich von Hautirritationen und genießen Sie einen strahlenden Teint. |

Cuidado de la piel orgánico para piel sensible con aloe vera y manzanilla: Descubre el poder de la naturaleza con nuestra línea de cuidado de la piel orgánico, diseñada especialmente para pieles sensibles. Enriquecidos con aloe vera y manzanilla, estos productos ofrecen una hidratación y protección suave. Despídete de las irritaciones y saluda a una piel radiante y saludable. |

针对敏感肌专门设计的天然有机护肤产品:体验由芦荟和洋甘菊提取物带来的自然呵护。我们的护肤产品特别为敏感肌设计,温和滋润,保护您的肌肤不受刺激。让您的肌肤告别不适,迎来健康光彩。 |

新しいメイクのトレンドは鮮やかな色と革新的な技術に焦点を当てています: 今シーズンのメイクアップトレンドは、大胆な色彩と革新的な技術に注目しています。ネオンアイライナーからホログラフィックハイライターまで、クリエイティビティを解き放ち、毎回ユニークなルックを演出しましょう。 |

upload

Anfrage

Bash

Sprache

arrow_drop_down

curl https://api.jina.ai/v1/embeddings \

-H "Content-Type: application/json" \

-H "Authorization: Bearer " \

-d @- <<EOFEOF

{

"normalized": true,

"embedding_type": "float",

"input": [

"Organic skincare for sensitive skin with aloe vera and chamomile: Imagine the soothing embrace of nature with our organic skincare range, crafted specifically for sensitive skin. Infused with the calming properties of aloe vera and chamomile, each product provides gentle nourishment and protection. Say goodbye to irritation and hello to a glowing, healthy complexion.",

"Bio-Hautpflege für empfindliche Haut mit Aloe Vera und Kamille: Erleben Sie die wohltuende Wirkung unserer Bio-Hautpflege, speziell für empfindliche Haut entwickelt. Mit den beruhigenden Eigenschaften von Aloe Vera und Kamille pflegen und schützen unsere Produkte Ihre Haut auf natürliche Weise. Verabschieden Sie sich von Hautirritationen und genießen Sie einen strahlenden Teint.",

"Cuidado de la piel orgánico para piel sensible con aloe vera y manzanilla: Descubre el poder de la naturaleza con nuestra línea de cuidado de la piel orgánico, diseñada especialmente para pieles sensibles. Enriquecidos con aloe vera y manzanilla, estos productos ofrecen una hidratación y protección suave. Despídete de las irritaciones y saluda a una piel radiante y saludable.",

"针对敏感肌专门设计的天然有机护肤产品:体验由芦荟和洋甘菊提取物带来的自然呵护。我们的护肤产品特别为敏感肌设计,温和滋润,保护您的肌肤不受刺激。让您的肌肤告别不适,迎来健康光彩。",

"新しいメイクのトレンドは鮮やかな色と革新的な技術に焦点を当てています: 今シーズンのメイクアップトレンドは、大胆な色彩と革新的な技術に注目しています。ネオンアイライナーからホログラフィックハイライターまで、クリエイティビティを解き放ち、毎回ユニークなルックを演出しましょう。"

]

}

EOFEOF

key

API-Schlüssel

visibility_off

Verfügbare Token

0

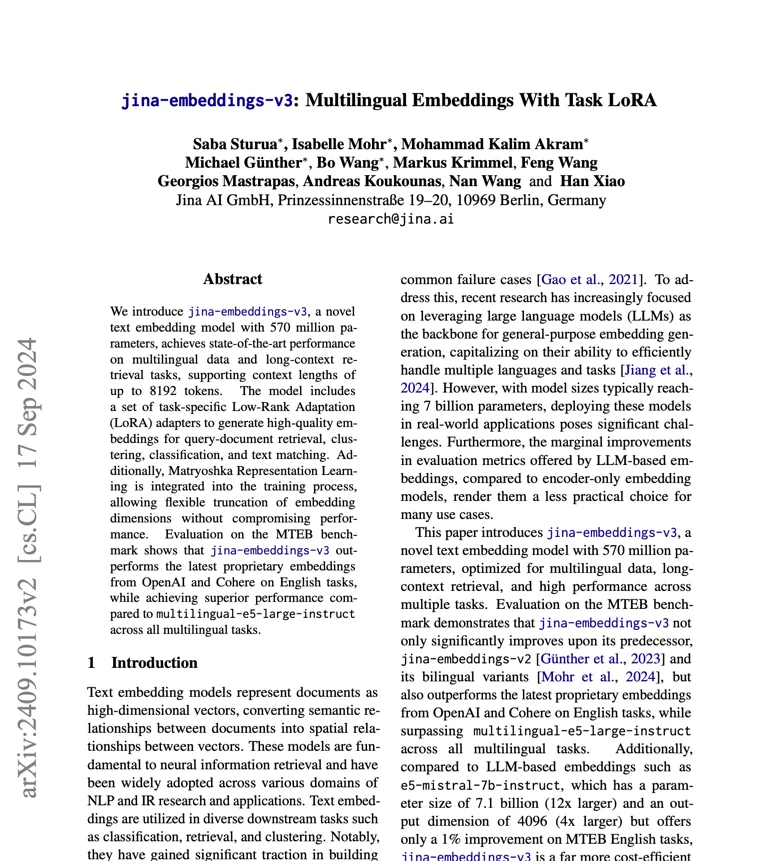

v5-Text: Neue SOTA kleine mehrsprachige Einbettungen

jina-embeddings-v5-text bietet Einbettungsqualität der fünften Generation in zwei effizienten Größen – einem kleinen Modell mit 677 Millionen und einem Nano-Modell mit 239 Millionen – mit aufgabenspezifischen LoRA-Adaptern, Matryoshka-Dimensionen, 32K Kontext und GGUF/MLX-Quantisierung für den Einsatz am Edge und setzt damit neue Maßstäbe für MMTEB, MTEB English und Retrieval-Aufgaben.

v4: Universelle Einbettungen für multimodale mehrsprachige Abfrage

jina-embeddings-v4 ist unser bisher bedeutendster Sprung – ein 3,8-B-Modell, das Text und Bilder über einen einheitlichen Pfad einbettet und sowohl dichtes als auch spätes Interaktionsabrufen unterstützt. Dabei übertrifft es proprietäre Modelle von Google, OpenAI und Voyage AI, insbesondere beim Abrufen visuell ansprechender Dokumente.

Zwei Kaufmöglichkeiten

Abonnieren Sie unsere API oder kaufen Sie über Cloud-Anbieter.

radio_button_unchecked

cloud

Mit 3 Cloud-Service-Anbietern

Verwendet Ihr Unternehmen AWS oder Azure? Dann setzen Sie unsere Suchgrundlagenmodelle direkt auf diesen Plattformen in Ihrem Unternehmen ein, damit Ihre Daten sicher und konform bleiben.

Bereitstellung vor Ort

Stellen Sie Jina Embeddings-Modelle in AWS Sagemaker und Microsoft Azure und bald auch in Google Cloud Services bereit, oder wenden Sie sich an unser Vertriebsteam, um angepasste Kubernetes-Bereitstellungen für Ihre Virtual Private Cloud und Ihre lokalen Server zu erhalten.

API-Integrationen

Unsere Einbettungs-API ist nativ in verschiedene renommierte Datenbanken, Vektorspeicher, RAG- und LLMOps-Frameworks integriert. Kopieren Sie zunächst einfach Ihren API-Schlüssel und fügen Sie ihn in eine der aufgeführten Integrationen ein, um einen schnellen und reibungslosen Start zu ermöglichen.

Vector Store

LLMOps

LAPPEN

Beobachtbarkeit

MongoDB

DataStax

Qdrant

Pinecone

Chroma

Weaviate

Milvus

Epsilla

MyScale

LlamaIndex

Haystack

Langchain

Dify

SuperDuperDB

DashVector

Portkey

Baseten

TiDB

LanceDB

Carbon

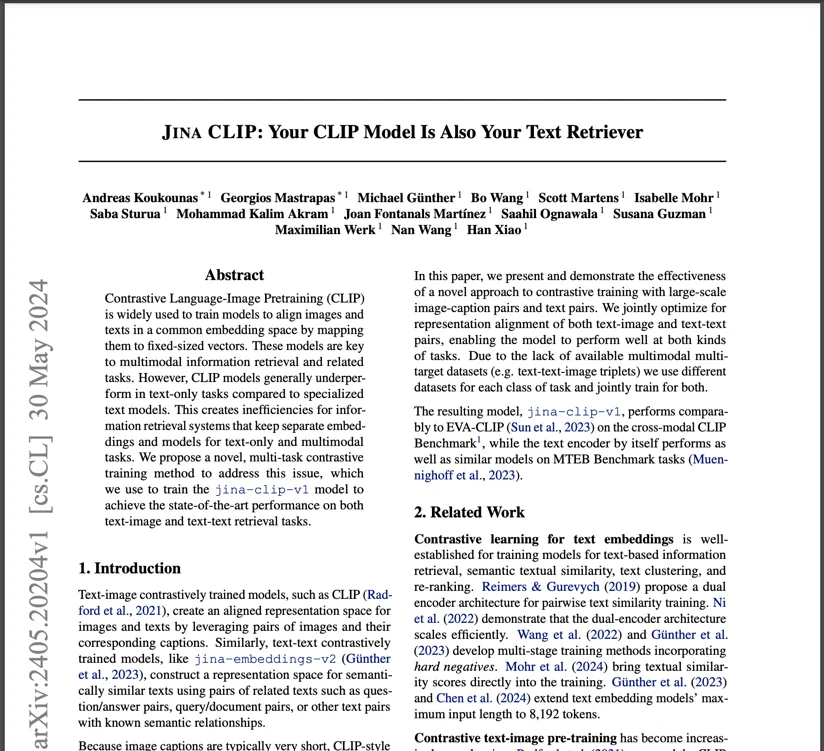

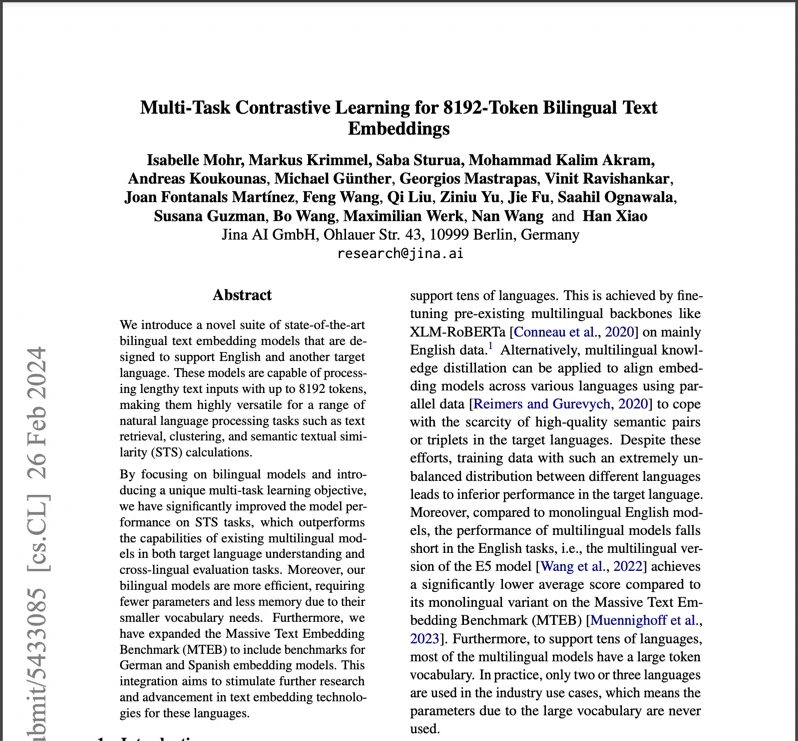

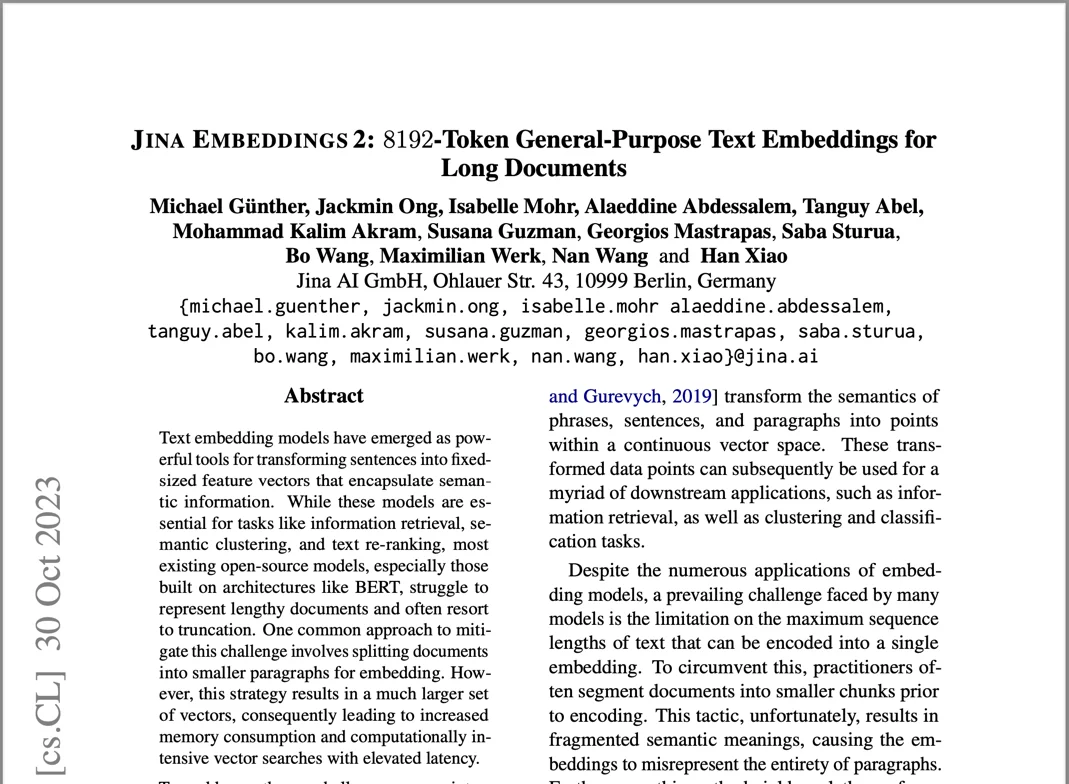

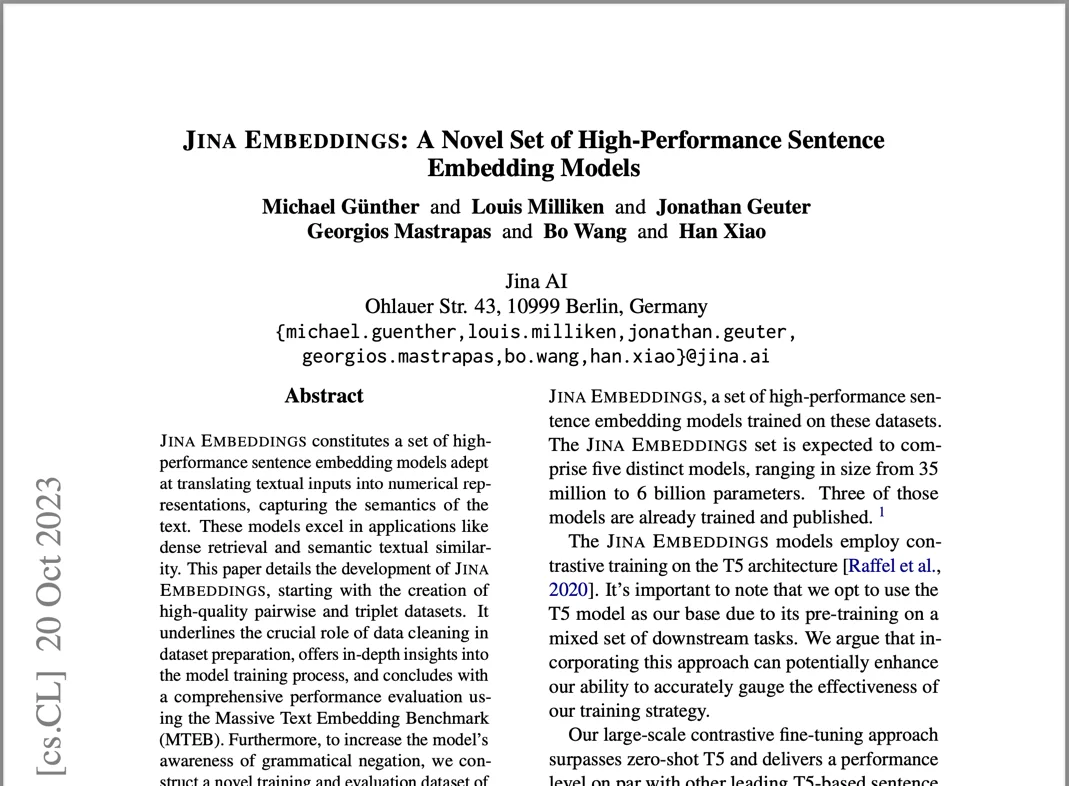

Unsere Veröffentlichungen

Erfahren Sie, wie unsere bahnbrechenden Suchmodelle von Grund auf trainiert wurden, und sehen Sie sich unsere neuesten Veröffentlichungen an. Lernen Sie unser Team bei EMNLP, SIGIR, ICLR, NeurIPS und ICML kennen!

Februar 17, 2026

Februar 11, 2026

ICLR 2026

Januar 22, 2026

Dezember 29, 2025

ICLR 2026

Dezember 04, 2025

AAAI 2026

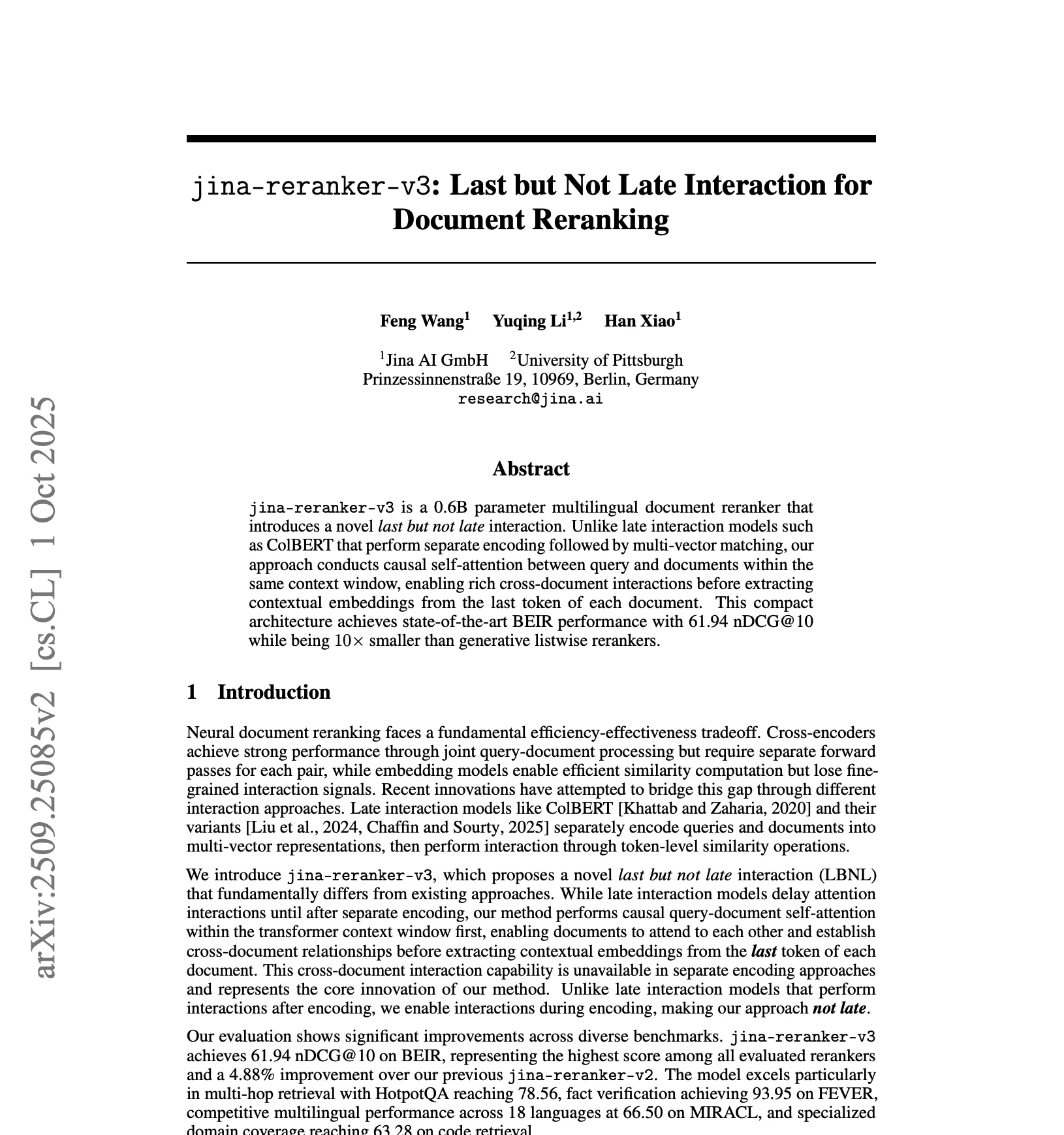

Oktober 01, 2025

NeurIPS 2025

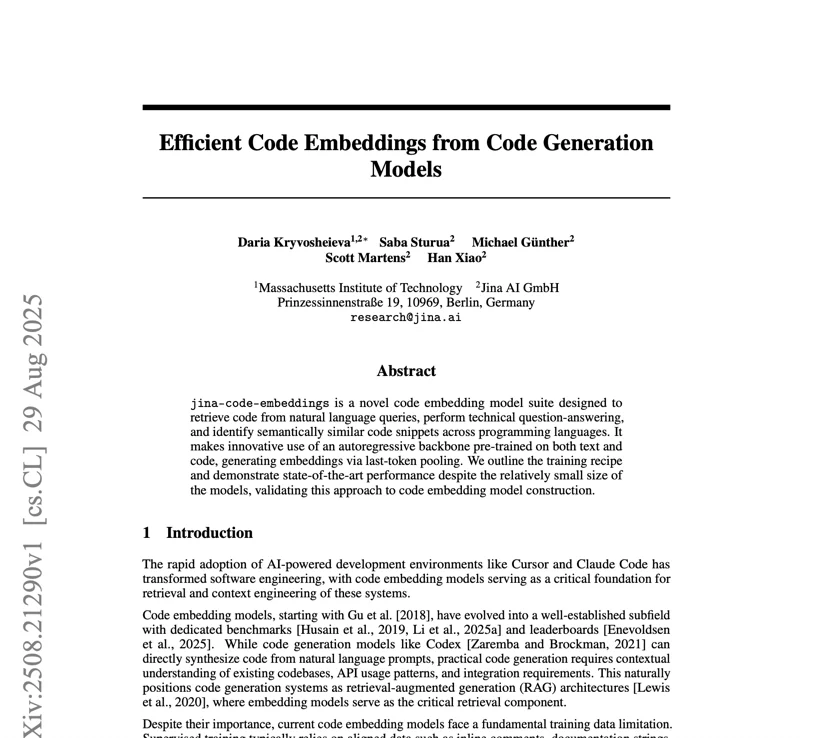

August 31, 2025

EMNLP 2025

Juni 24, 2025

ICLR 2025

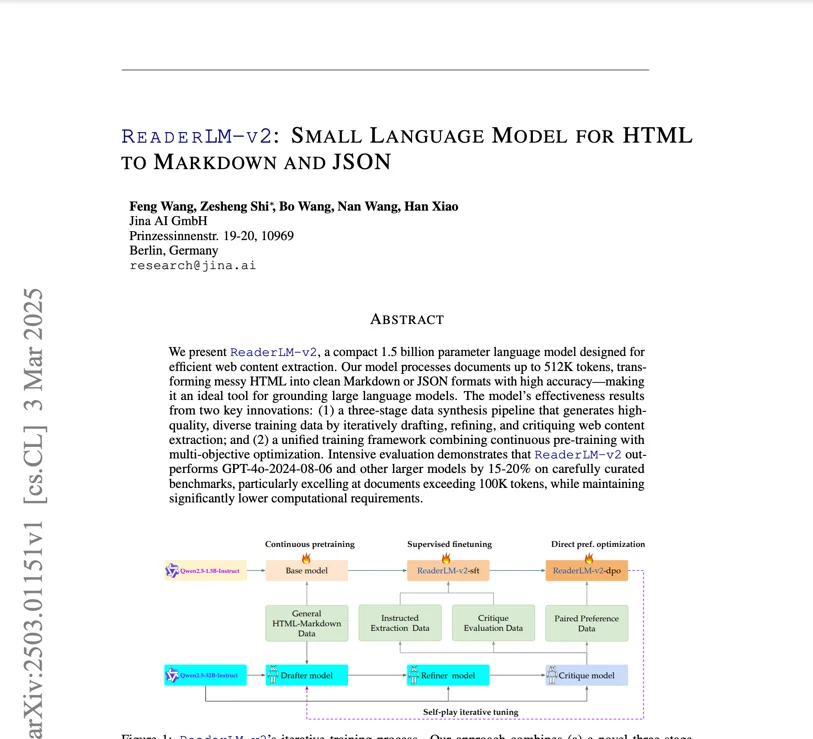

März 04, 2025

ACL 2025

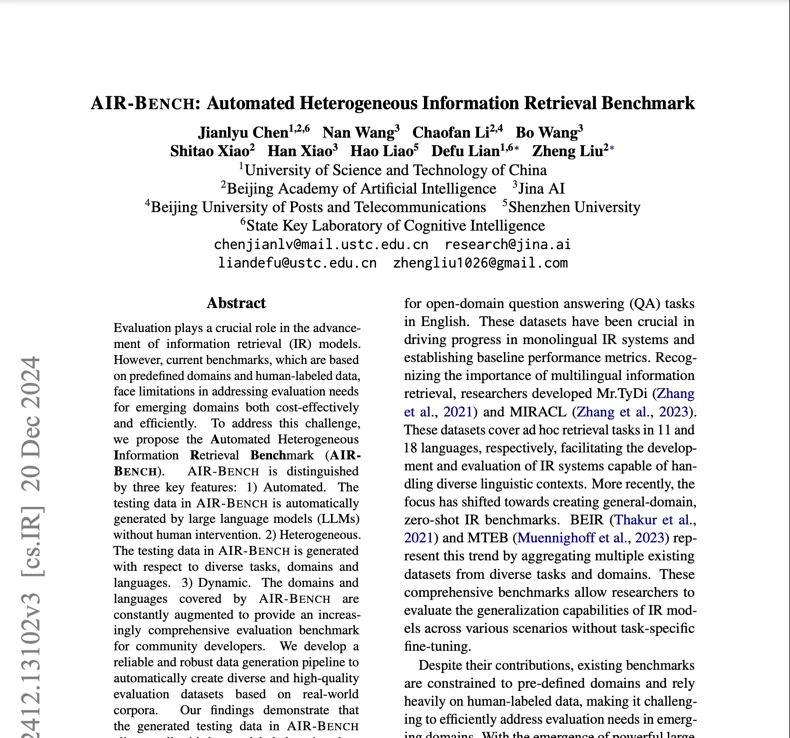

Dezember 17, 2024

ICLR 2025

Dezember 12, 2024

ECIR 2025

September 18, 2024

SIGIR 2025

September 07, 2024

EMNLP 2024

August 30, 2024

WWW 2025

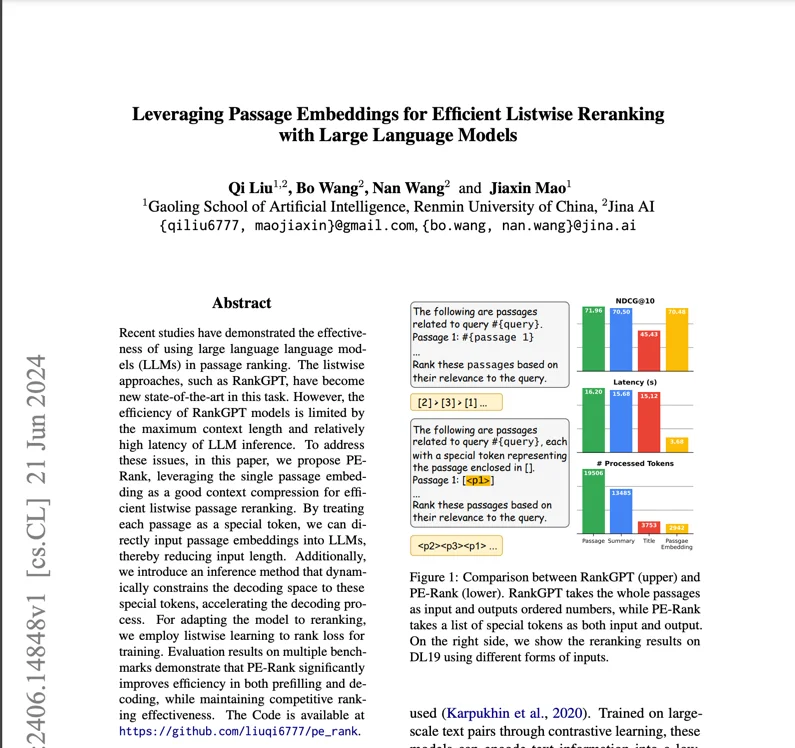

Juni 21, 2024

ICML 2024

Mai 30, 2024

Februar 26, 2024

Oktober 30, 2023

EMNLP 2023

Juli 20, 2023

19 Veröffentlichungen insgesamt.

Erfahren Sie mehr über Einbettungen

Wo soll man mit Einbettungen anfangen? Wir geben dir Deckung. Erfahren Sie mehr über Einbettungen von Grund auf mit unserem umfassenden Leitfaden.

Die Evolution des Einbettungsplakats

Entdecken Sie das ideale Poster für Ihren Raum mit fesselnden Infografiken oder atemberaubenden Bildern, die die Entwicklung der Texteinbettungsmodelle seit 1950 nachzeichnen.

Wie wurden die Jina-Einbettungsmodelle trainiert?

keyboard_arrow_down

Welche multimodalen Einbettungsmodelle verwenden Sie?

keyboard_arrow_down

Welche Sprachen unterstützen Ihre Modelle?

keyboard_arrow_down

Was ist die maximale Länge für die Eingabe eines einzelnen Satzes?

keyboard_arrow_down

Wie viele Sätze kann ich maximal in eine einzelne Anfrage einfügen?

keyboard_arrow_down

Wie sende ich Bilder an multimodale Einbettungsmodelle?

keyboard_arrow_down

Wie schneiden Jina-Embeddings-Modelle im Vergleich zu den neuesten Embeddings von OpenAI und Cohere ab?

keyboard_arrow_down

Wie nahtlos ist der Übergang von OpenAIs Text-Embedding-3-Large zu Ihrer Lösung?

keyboard_arrow_down

Wie werden Token bei der Verwendung von Jina-Clip-Modellen berechnet?

keyboard_arrow_down

Bieten Sie Modelle zum Einbetten von Bildern oder Audio an?

keyboard_arrow_down

Können Jina Embedding-Modelle mit privaten oder Unternehmensdaten verfeinert werden?

keyboard_arrow_down

Können Ihre Endpunkte privat auf AWS, Azure oder GCP gehostet werden?

keyboard_arrow_down

Was ist der Parameter „task“ und wann sollte ich ihn verwenden?

keyboard_arrow_down

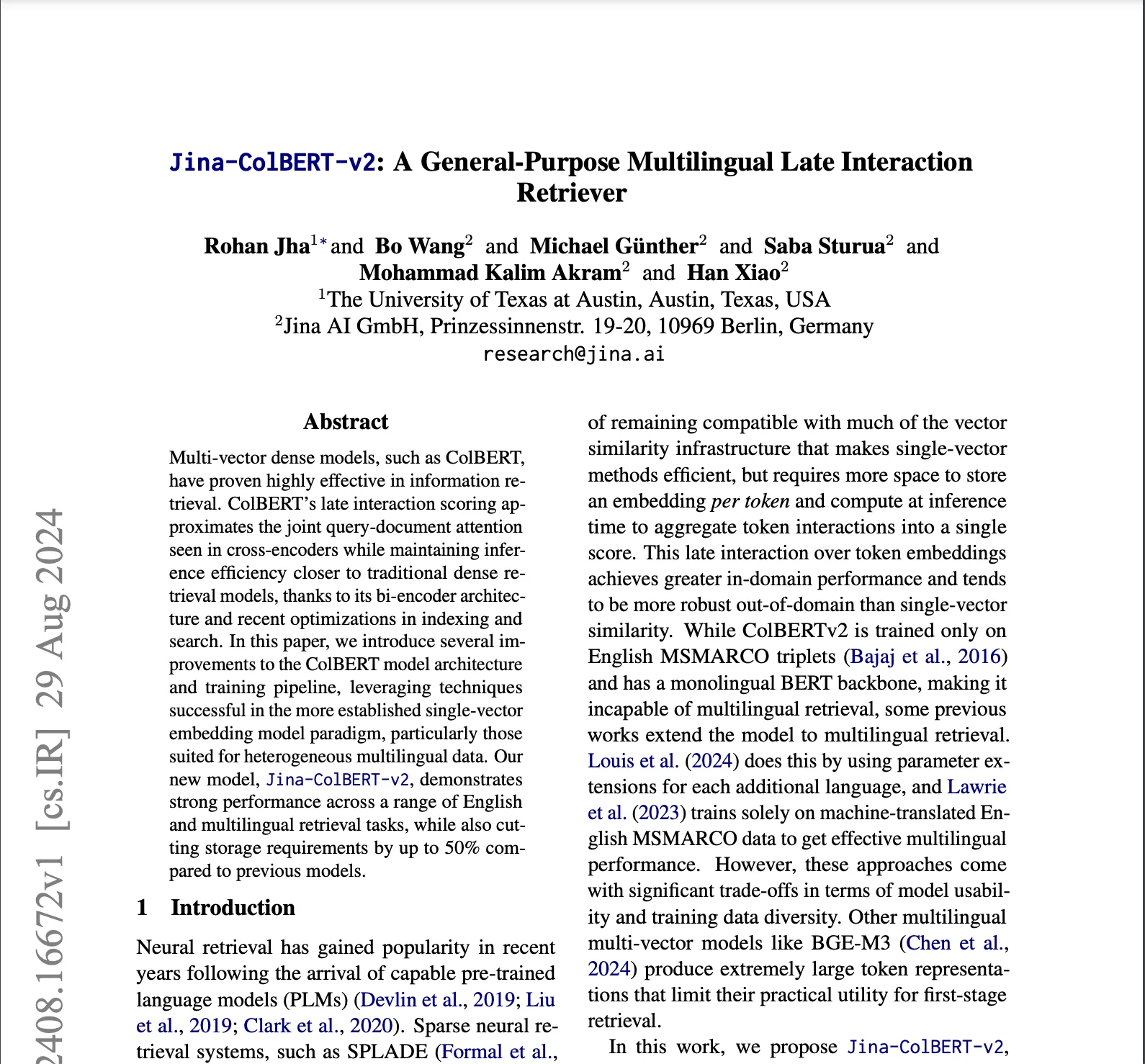

Was versteht man unter „Late-Interaction Retrieval“ und welche Modelle unterstützen es?

keyboard_arrow_down

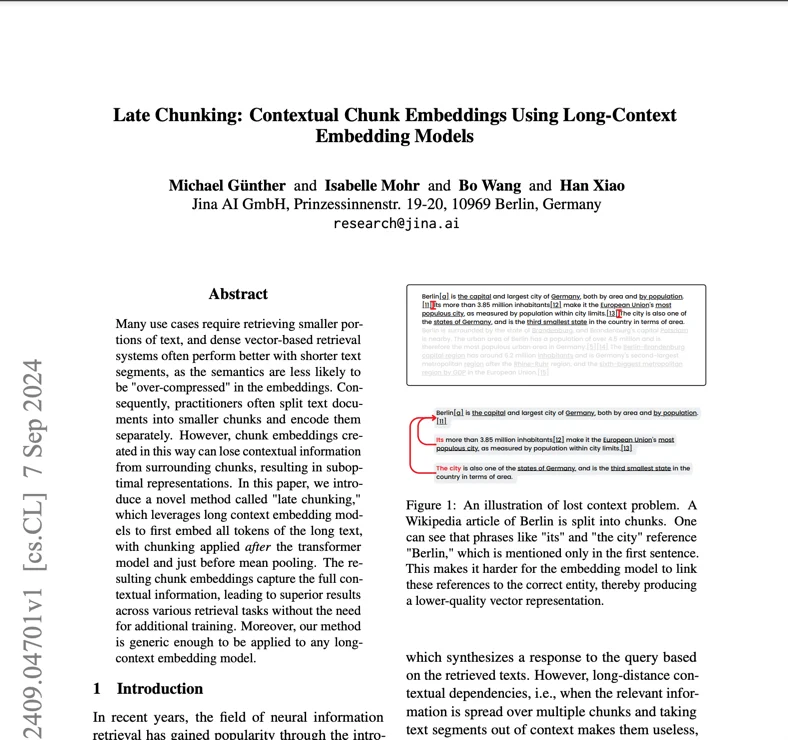

Was ist Late Chunking und wann sollte ich es anwenden?

keyboard_arrow_down

Warum unterstützt die API eine andere Kontextlänge als die maximale Kapazität des Modells?

keyboard_arrow_down

Warum ist jina-embeddings-v4 kostenlos und warum ist es langsam?

keyboard_arrow_down

Welche Ratenbegrenzungen gelten für die Embeddings API?

keyboard_arrow_down

Welche Beschränkungen gelten für die Kontextlänge der einzelnen Einbettungsmodelle?

keyboard_arrow_down

Welche Dateigrößenbeschränkungen gelten für Bilder und PDFs?

keyboard_arrow_down

Ratenbegrenzung

Ratenbegrenzungen werden auf drei Arten verfolgt: RPM (Anfragen pro Minute) und TPM (Token pro Minute). Die Begrenzungen werden pro IP/API-Schlüssel erzwungen und ausgelöst, wenn zuerst der RPM- oder TPM-Schwellenwert erreicht wird. Wenn Sie im Anforderungsheader einen API-Schlüssel angeben, verfolgen wir die Ratenbegrenzungen nach Schlüssel und nicht nach IP-Adresse.

Spalten

arrow_drop_down

| Produkt | API-Endpunkt | Beschreibungarrow_upward | ohne API-Schlüsselkey_off | mit kostenlosem API-Schlüsselkey | mit kostenpflichtigem API-Schlüsselkey | mit Premium-API-Schlüsselkey | Durchschnittliche Latenz | Zählung der Token-Nutzung | Zulässige Anfrage | |

|---|---|---|---|---|---|---|---|---|---|---|

| Leser-API | https://r.jina.ai | URL in LLM-freundlichen Text konvertieren | 20 RPM | 500 RPM | 500 RPM | trending_up5000 RPM | 7.9s | Zählen Sie die Anzahl der Token in der Ausgabeantwort. | GET/POST | |

| Leser-API | https://s.jina.ai | Durchsuchen Sie das Web und konvertieren Sie die Ergebnisse in LLM-freundlichen Text | block | 100 RPM | 100 RPM | trending_up1000 RPM | 2.5s | Jede Anfrage kostet eine feste Anzahl an Token, beginnend bei 10000 Token | GET/POST | |

| Einbettungs-API | https://api.jina.ai/v1/embeddings | Konvertieren Sie Text/Bilder in Vektoren mit fester Länge | block | 100 RPM & 100,000 TPM | 500 RPM & 2,000,000 TPM | trending_up5,000 RPM & 50,000,000 TPM | ssid_chart hängt von der Eingangsgröße ab help | Zählen Sie die Anzahl der Token in der Eingabeanforderung. | POST | |

| Reranker-API | https://api.jina.ai/v1/rerank | Ordnen Sie Dokumente nach Abfrage | block | 100 RPM & 100,000 TPM | 500 RPM & 2,000,000 TPM | trending_up5,000 RPM & 50,000,000 TPM | ssid_chart hängt von der Eingangsgröße ab help | Zählen Sie die Anzahl der Token in der Eingabeanforderung. | POST | |

| Klassifizierer-API | https://api.jina.ai/v1/train | Trainieren eines Klassifikators anhand gekennzeichneter Beispiele | block | 25 RPM & 25,000 TPM | 125 RPM & 500,000 TPM | 1,250 RPM & 12,000,000 TPM | ssid_chart hängt von der Eingangsgröße ab | Token werden wie folgt gezählt: input_tokens × num_iters | POST | |

| Klassifizierer-API (Nullschuss) | https://api.jina.ai/v1/classify | Klassifizieren Sie Eingaben mithilfe der Zero-Shot-Klassifizierung | block | 25 RPM & 25,000 TPM | 125 RPM & 500,000 TPM | 1,250 RPM & 12,000,000 TPM | ssid_chart hängt von der Eingangsgröße ab | Token werden wie folgt gezählt: input_tokens + label_tokens | POST | |

| Klassifizierer-API (Wenige Schüsse) | https://api.jina.ai/v1/classify | Klassifizieren Sie Eingaben mit einem trainierten Few-Shot-Klassifikator | block | 25 RPM & 25,000 TPM | 125 RPM & 500,000 TPM | 1,250 RPM & 12,000,000 TPM | ssid_chart hängt von der Eingangsgröße ab | Token werden wie folgt gezählt: input_tokens | POST | |

| Segmenter-API | https://api.jina.ai/v1/segment | Tokenisieren und Segmentieren von Langtext | 20 RPM | 200 RPM | 200 RPM | 1,000 RPM | 0.3s | Token werden nicht als Nutzung gezählt. | GET/POST | |

| DeepSearch | https://deepsearch.jina.ai/v1/chat/completions | Überlegen, suchen und iterieren, um die beste Antwort zu finden | block | 50 RPM | 50 RPM | 500 RPM | 56.7s | Zählen Sie die Gesamtzahl der Token im gesamten Vorgang. | POST |

CC BY-NC Lizenz Selbstcheck

play_arrow

Nutzen Sie unsere offizielle API oder offizielle Images auf Azure, AWS oder GCP?

play_arrow

Ja

play_arrow

NEIN

Häufige Fragen zu APIs

code

Kann ich denselben API-Schlüssel für Reader-, Einbettungs-, Neurang-, Klassifizierungs- und Feinabstimmungs-APIs verwenden?

keyboard_arrow_down

code

Kann ich die Token-Nutzung meines API-Schlüssels überwachen?

keyboard_arrow_down

code

Was soll ich tun, wenn ich meinen API-Schlüssel vergesse?

keyboard_arrow_down

code

Laufen API-Schlüssel ab?

keyboard_arrow_down

code

Kann ich Token zwischen API-Schlüsseln übertragen?

keyboard_arrow_down

code

Kann ich meinen API-Schlüssel widerrufen?

keyboard_arrow_down

code

Warum ist die erste Anfrage für einige Modelle langsam?

keyboard_arrow_down

code

Werden meine API-Daten zum Trainieren Ihrer Modelle verwendet?

keyboard_arrow_down

code

Welche Ratenbegrenzungen gelten für Jina-APIs?

keyboard_arrow_down

code

Gibt es Beschränkungen hinsichtlich der Batchgröße für die APIs?

keyboard_arrow_down

Häufige Fragen zur Abrechnung

attach_money

Erfolgt die Abrechnung nach der Anzahl der Sätze bzw. Anfragen?

keyboard_arrow_down

attach_money

Gibt es eine kostenlose Testversion für neue Benutzer?

keyboard_arrow_down

attach_money

Werden für fehlgeschlagene Anfragen Token berechnet?

keyboard_arrow_down

attach_money

Welche Zahlungsmethoden werden akzeptiert?

keyboard_arrow_down

attach_money

Ist eine Rechnungsstellung für Token-Käufe verfügbar?

keyboard_arrow_down