I/O 圖 1

I/O 圖 2

I/O 圖 3

選擇要比較的模型

出版物 (1)

概述

ReaderLM-v2 是一個 1.5B 參數語言模型,可將原始 HTML 轉換為 markdown 或 JSON,處理最多 512K 個詞元組合輸入/輸出長度,支持 29 種語言。與將 HTML 到 markdown 視為“選擇性複製”任務的前身不同,v2 將其視為翻譯過程,從而能夠出色地處理代碼圍欄、嵌套列表、表格和 LaTeX 方程式等複雜元素。該模型在不同的上下文長度下保持一致的性能,並引入了具有預定義架構的直接 HTML 到 JSON 生成功能。

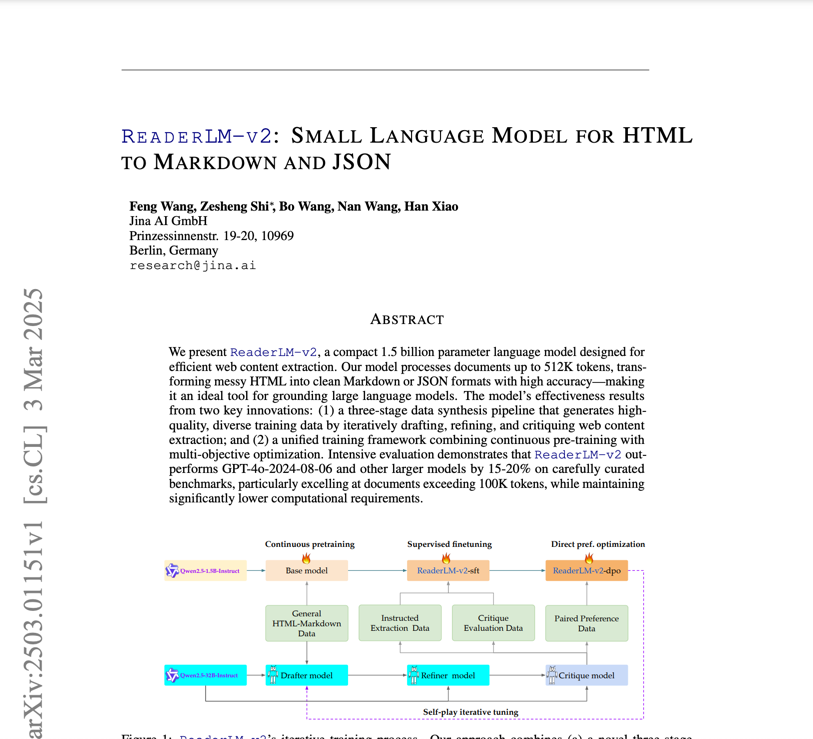

方法

ReaderLM-v2 基於 Qwen2.5-1.5B-Instruction 構建,其訓練基於一個包含一千萬個 HTML 文檔的 html-markdown-1m 數據集,每個文檔平均包含 56,000 個 token。訓練過程包括:1) 使用 Ring-zag Attention 和 RoPE 進行長上下文預訓練,將上下文從 32,000 個 token 擴展到 256,000 個 token;2) 使用精煉數據集進行監督微調;3) 直接偏好優化以實現輸出對齊;以及 4) 自我對弈強化調整。數據準備遵循由 Qwen2.5-32B-Instruction 驅動的三步流程(起草-精煉-評審),其中針對特定任務訓練了專門的模型,然後通過線性參數插值進行合併。

性能

在綜合基準測試中,ReaderLM-v2 在 HTML 到 Markdown 任務上的表現優於 Qwen2.5-32B-Instruct 和 Gemini2-flash-expr 等大型模型。對於主要內容提取,它實現了 0.84 的 ROUGE-L、0.82 的 Jaro-Winkler,並且與競爭對手相比,Levenshtein 距離 (0.22) 明顯更低。在 HTML 到 JSON 任務中,它保持了具有競爭力的性能,F1 得分為 0.81,通過率為 98%。該模型在 T4 GPU 上以 67 個 token/s 的輸入和 36 個 token/s 的輸出進行處理,通過對比損失訓練顯著減少了退化問題。

最佳實踐

該模型可通過 Google Colab 筆記本訪問,該筆記本演示了 HTML 到 Markdown 的轉換、JSON 提取和指令遵循。對於 HTML 到 Markdown 任務,用户可以輸入沒有前綴指令的原始 HTML,而 JSON 提取則需要特定的架構格式。create_prompt 輔助函數有助於輕鬆為這兩個任務創建提示。雖然該模型可以在 Colab 的免費 T4 GPU 層上運行(需要 vllm 和 triton),但如果不支持 bfloat16 或 flash Attention 2,則存在侷限性。建議將 RTX 3090/4090 用於生產用途。該模型將在 AWS SageMaker、Azure 和 GCP 市場上提供,根據 CC BY-NC 4.0 許可用於非商業用途。

提及此模型的博客