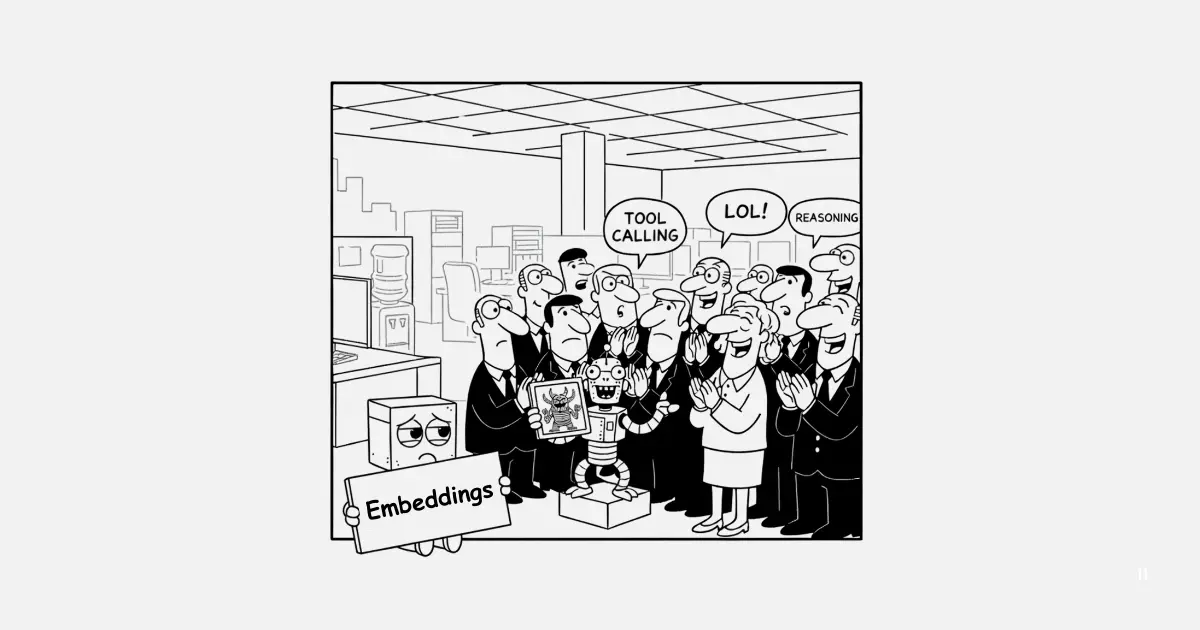

Les modèles d'embeddings sont le parent pauvre de l'IA. Moins sexy que la génération d'images, moins médiatisés que les chatbots LLM, et moins apocalyptiques que les prédictions de superintelligence artificielle, les embeddings sémantiques sont ésotériques et techniques, et les consommateurs ordinaires n'en ont pas beaucoup d'utilité directe.

Les embeddings sont des vecteurs qui traduisent la sémantique en relations géométriques dans des espaces de haute dimension. Mais essayez d'en parler à quelqu'un qui ne les utilise pas, et vous verrez ses yeux s'éteindre d'ennui.

Cela ne veut pas dire qu'ils ne sont pas importants, voire révolutionnaires. Représenter la sémantique des textes sous forme de vecteurs dans des espaces de haute dimension existe depuis les années 1950, mais les réseaux neuronaux avec des architectures de transformeurs l'ont étendu à la parole, aux images, à la vidéo et à presque tous les types de données numériques. Les améliorations qualitatives de la sémantique computationnelle au cours de la dernière décennie ont été transformatrices, et les implications pour les moteurs de recherche, les algorithmes de recommandation, les classificateurs automatisés et les systèmes de décision ont été énormes, même si elles font rarement la une des journaux.

Un aspect méconnu de cette révolution sous-estimée est que la plupart des réseaux neuronaux, y compris les plus récents basés sur des transformeurs, sont implicitement des modèles d'embeddings. Les grands modèles de langage, les modèles génératifs d'images et les systèmes de traduction automatique fonctionnent tous en traduisant leurs entrées en espaces vectoriels de haute dimension qui préservent leur sémantique essentielle — c'est-à-dire en créant des embeddings — et en utilisant ensuite cela pour produire une sortie. Ces modèles peuvent être facilement réutilisés pour générer des embeddings pour la recherche d'informations et d'autres usages.

Dans cet article, nous allons aborder les principales questions liées à l'utilisation de modèles de langage génératifs (par exemple, les LLM) pour produire des embeddings de texte, et comment nous utilisons ce travail pour améliorer nos modèles.

tagEncodeurs et Décodeurs

Les termes "encodeur" et "décodeur" sont beaucoup utilisés dans le développement de modèles d'IA, mais souvent de manière très confuse. Ces termes sont liés à des concepts de l'ingénierie électrique et de la théorie de l'information, et remontent à une époque où les réseaux neuronaux étaient plus théoriques que pratiques.

Dans sa conception originale, un encodeur convertit son entrée en une forme utilisable par une machine, et un décodeur fait l'inverse, convertissant les données en quelque chose de plus utile pour l'homme. Si cela vous semble très abstrait, c'est parce que ça l'est. Pour vous aider, examinons quelques exemples concrets.

Dans l'électronique numérique traditionnelle (pas l'IA), un encodeur est un dispositif qui convertit une source d'entrée riche, comme un son analogique capturé par un microphone, en une séquence binaire qui peut être stockée dans la mémoire d'un ordinateur, sur un support numérique physique, ou transmise sur un réseau numérique comme l'internet.

Une grande partie des premiers travaux qui ont mené aux modèles d'embeddings et à l'IA générative concernait la traduction automatique, où l'architecture de base correspondait étroitement à cette image.

Vous pouvez considérer un modèle d'embeddings comme la moitié "encodeur" d'un modèle de traduction automatique encodeur-décodeur, avec un adaptateur supplémentaire pour produire des vecteurs d'embeddings.

Et vous pouvez considérer un modèle génératif comme la moitié "décodeur" :

Il peut être très contre-intuitif de penser aux modèles de réseaux neuronaux de cette manière. La relation entre la modélisation des données, la sémantique et la compression est compliquée et très abstraite, mais elle est importante pour comprendre comment nous appréhendons les modèles d'IA. La différence entre les modèles d'encodeur et de décodeur réside dans la façon dont ils sont utilisés, et non dans leur architecture.

tagLes Encodeurs et Décodeurs Basés sur les Transformeurs sont les Mêmes

Les encodeurs et les décodeurs sont des concepts assez abstraits, mais si nous parlons de modèles basés sur des transformeurs, ils ont tous deux des architectures presque identiques.

Les exemples ci-dessous sont indicatifs des modèles de langage génératifs et des modèles d'embeddings de texte, mais avec quelques petites modifications, la même chose s'applique à d'autres types de médias.

Les modèles "encodeur uniquement" et "décodeur uniquement" prennent des textes en entrée et appliquent une tokenisation puis une vectorisation — en recherchant essentiellement les tokens dans un dictionnaire et en substituant le vecteur approprié à chacun — puis ajoutent un remplissage si nécessaire. Le résultat est un vecteur d'entrée de longueur fixe pour le reste du modèle.

Dans un modèle de langage génératif "décodeur uniquement", ce vecteur d'entrée est transmis à un modèle de transformeur puis à un adaptateur de décodeur qui transforme sa sortie en un ou plusieurs tokens. Les modèles de génération de texte ajoutent ensuite ces nouveaux tokens à l'entrée et relancent le processus pour ajouter d'autres tokens.

Presque toute cette image est partagée avec les architectures d'embeddings de texte basées sur des transformeurs, sauf qu'au lieu d'un appareil de décodeur produisant des tokens, un appareil d'encodeur produit un embedding.

Les principales différences entre les deux ne sont pas fondamentalement architecturales ; elles résident dans la façon dont ils sont entraînés et utilisés.

Les modèles de langage génératifs sont généralement unidirectionnels (ou "causals") : Ils génèrent le token suivant en ne regardant que le token précédent. Les modèles d'embeddings sont généralement bidirectionnels (ou "non causals").

Cela affecte la façon dont ils sont entraînés. L'entraînement des modèles génératifs reflète cela, en apprenant à partir de quantités de texte, qui lui sont transmises un token à la fois. Les modèles d'embeddings sont généralement pré-entraînés à l'aide de techniques de "modélisation de langage masquée" (MLM), ce qui signifie qu'ils examinent les mots avant et après un trou pour générer une représentation sémantique du mot manquant.

Néanmoins, en principe, convertir un LLM génératif en un modèle d'embeddings consiste simplement à remplacer l'appareil de décodeur par un encodeur et à l'affiner pour la nouvelle utilisation.

Alors, pourquoi ne le faisons-nous pas ?

tagLes Encodeurs et Décodeurs Basés sur les Transformeurs sont Différents

Les chercheurs ont avancé trois grandes raisons de ne pas convertir les modèles de langage génératifs en modèles d'embeddings de texte, mais chacune d'entre elles a été remise en question récemment.

L'attention bidirectionnelle ("non causale") est meilleure que l'attention unidirectionnelle ("causale").

Depuis le modèle BERT séminal, nous avons tenu pour acquis que l'attention bidirectionnelle est meilleure que l'unidirectionnelle simplement parce que plus d'informations sont disponibles. Le modèle peut voir les tokens dans leur contexte complet, et pas seulement dans le contexte des mots précédents.

Cependant, des études plus récentes (Wang et al. 2023, Gisserot-Boukhlef et al. 2025) suggèrent qu'il n'y a pas de grande différence dans les résultats entre le pré-entraînement bidirectionnel et unidirectionnel, bien qu'il y ait quelques petits avantages à chacun, en fonction des facteurs que vous examinez.

Les LLM génératifs souffrent du fléau de la dimensionnalité, ce qui les rend mauvais en généralisation.

Les LLM ne sont pas conçus pour être de bons modèles d'embeddings. Leurs représentations vectorielles internes — les couches cachées — ont généralement beaucoup plus de dimensions qu'un modèle d'embeddings n'en aurait. Les modèles sont trop grands et ils peuvent échouer à généraliser parce qu'un grand espace sémantique n'a pas à contenir des représentations compactes.

Ce problème est parfois appelé le fléau de la dimensionnalité, et il affecte les réseaux neuronaux.

Contrairement aux 向量模型, les modèles de langage génératifs sont notés sur une courbe. Les modèles génératifs n'utilisent pas directement ces vecteurs 向量模型 internes ; ils utilisent le langage qui provient de leur transformation en 词元. Si le modèle semble parler avec fluidité et cohérence, nous le classons bien. Les modèles de 向量模型, en revanche, ont des tâches réelles à accomplir qui exigent une généralisation correcte. La malédiction de la dimensionnalité ne semble donc pas si importante pour les modèles génératifs, mais elle est mortelle pour un modèle de 向量模型.

Récemment, cependant, les modèles de langage génératifs se sont débarrassés d'une partie de la malédiction de la dimensionnalité. Les petits modèles de langage génératifs (SLM) haute performance de moins de 10 milliards de paramètres sont désormais monnaie courante, et bien qu'ils soient davantage motivés par le désir d'avoir des modèles de langage plus petits et plus efficaces que par un intérêt pour les 向量模型, nous pouvons toujours en tirer parti pour construire de meilleurs modèles.

Les gens ont déjà essayé, et cela n'a pas très bien fonctionné.

La dualité des modèles de 向量模型 et des modèles génératifs n'est pas nouvelle, mais les modèles de 向量模型 adaptés à partir de modèles génératifs ont généralement été beaucoup plus grands que les modèles de 向量模型 aux performances comparables. OpenAI a adapté GPT-3 pour les 向量模型 en 2022, mais, malgré environ 175 milliards de paramètres, il offre des performances à peu près équivalentes à celles des modèles de 向量模型 entraînés par MLM de moins d'un milliard de paramètres.

Cependant, la famille de modèles NV-Embed, qu'NVIDIA a adaptée à partir du SLM Mistral-7B de 7 milliards de paramètres, a atteint des performances de pointe sur les benchmarks de 向量模型 standard. C'est une preuve suffisante que l'adaptation des modèles de langage génératifs peut très bien fonctionner en pratique.

tagAvantages de l'adaptation des modèles génératifs

La réutilisation des modèles de langage génératifs de style décodeur pour les 向量模型 de style encodeur peut ne pas avoir d'inconvénients, mais elle ne semble pas non plus avoir d'avantages, du moins sur le papier. Mais en pratique, il y a quelques avantages tangibles.

Premièrement, les modèles de langage génératifs sont au centre de nombreuses recherches et de nombreux investissements parce qu'ils sont la partie sexy de l'IA. Les modèles de 向量模型 adaptés à partir d'eux peuvent s'approprier cette attention et cet effort supplémentaires à peu de frais supplémentaires. Le développement et l'entraînement d'un nouveau modèle de 向量模型 à partir de zéro est une opération coûteuse par rapport au réglage fin contrastif utilisé pour optimiser un modèle pré-entraîné, de sorte que cet avantage purement économique est assez important.

Par exemple, nos modèles récemment publiés jina-code-embeddings-1.5b et jina-code-embeddings-0.5b sont les premiers modèles de 向量模型 de code basés sur des backbones de génération de code, plus précisément Qwen2.5-Coder-1.5B et Qwen2.5-Coder-0.5B, respectivement. Nous avons considérablement amélioré leurs performances de 向量模型 parce que nous avons pu concentrer toute notre attention sur leur entraînement pour obtenir de bons 向量模型 au lieu de faire un pré-entraînement complexe et coûteux.

Deuxièmement, il est possible de transférer les capacités des modèles génératifs à de nouveaux domaines.

Le modèle jina-embeddings-v4 fait exactement cela. Il adapte Qwen2.5-VL-3B-Instruct, un modèle de vision-langage de 3,8 milliards de paramètres, pour les 向量模型 multimodaux. Ses performances exceptionnelles en tant que modèle de 向量模型 pour les diagrammes, les captures d'écran et autres entrées d'images de documents visuels reposent sur les capacités de compréhension du langage naturel préexistantes du modèle génératif. Au lieu d'entraîner d'abord un modèle à partir de zéro pour comprendre le langage, puis pour analyser le texte imprimé dans les images, et enfin pour produire de bons 向量模型, nous avons pu transférer les connaissances d'un modèle de 向量模型 d'images préexistant et d'un modèle de langage génératif, en nous concentrant plutôt sur l'entraînement contrastif pour les tâches de 向量模型.

tagLes 向量模型 font le travail

Toutes choses égales par ailleurs, il n'y a pas d'avantage clair à utiliser des modèles de langage génératifs comme base d'un modèle de 向量模型. Si vous devez construire un modèle de 向量模型 de texte à partir de zéro, il ne semble pas y avoir beaucoup de différence si vous utilisez un pré-entraînement bidirectionnel ou unidirectionnel. Investir dans la qualité des données, la spécialisation des tâches et le réglage fin pour la qualité des 向量模型 compte beaucoup plus.

Mais toutes choses ne sont pas égales par ailleurs.

Les modèles de 向量模型 ne voient rien de tel que le financement que reçoivent les modèles de langage génératifs, et l'utilisation de leurs modèles comme base nous permet de consacrer plus d'efforts à la création de meilleurs modèles de 向量模型 en raison des ressources qu'ils ont consacrées à leur pré-entraînement.

Les 向量模型 sont confrontés à des problèmes particuliers parce qu'ils n'ont pas les démonstrations impressionnantes pour lesquelles l'IA générative est si célèbre. Au lieu de cela, ils ont des cas d'utilisation importants et bien réels dans lesquels la précision, la qualité et le coût comptent pour tout. La recherche d'informations, les tâches de classification, les systèmes de recommandation, la détection du spam et de la fraude et la modération du contenu — ce sont tous des emplois réels que les modèles de 向量模型 font maintenant.

Les 向量模型 ne sont pas si sexy, mais ils font le travail. Donc, si nous pouvons nous réapproprier un peu du travail mieux financé du côté sexy de l'IA pour ses enfants terribles, cela semble assez juste.