Disponibile tramite

Scegli i modelli da confrontare

Pubblicazioni (3)

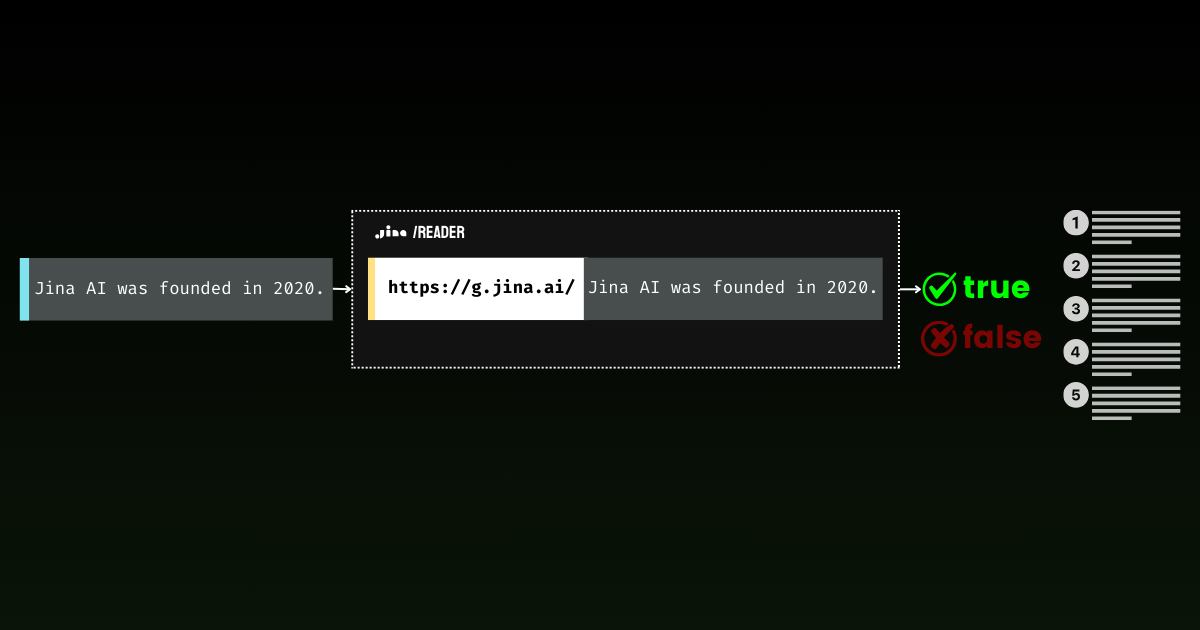

Panoramica

Jina Embeddings v2 Base English è un modello di incorporamento di testo open source rivoluzionario che risolve la sfida critica dell'elaborazione di documenti lunghi mantenendo un'elevata accuratezza. Le organizzazioni che hanno difficoltà ad analizzare documenti legali, relazioni di ricerca o report finanziari estesi troveranno questo modello particolarmente prezioso. Si distingue per la gestione di documenti lunghi fino a 8.192 token, 16 volte di più rispetto ai modelli tradizionali, eguagliando le prestazioni delle soluzioni proprietarie di OpenAI. Con una dimensione compatta di 0,27 GB e un utilizzo efficiente delle risorse, offre una soluzione accessibile per i team che cercano di implementare un'analisi avanzata dei documenti senza un sovraccarico computazionale eccessivo.

Metodi

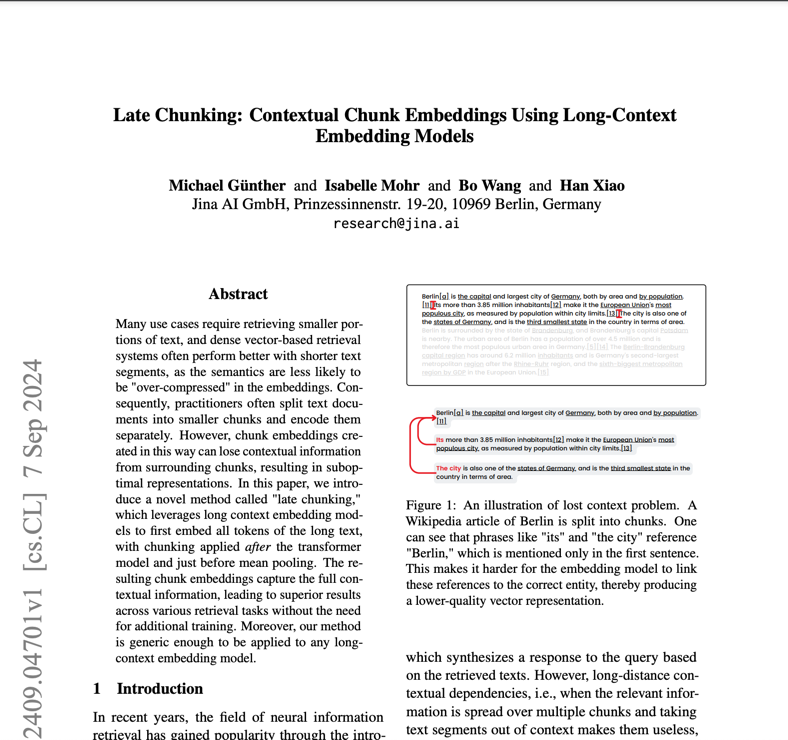

L'architettura del modello combina un backbone BERT Small con un innovativo meccanismo ALiBi (Attention with Linear Biases) bidirezionale simmetrico, eliminando la necessità di tradizionali incorporamenti posizionali. Questa scelta architettonica consente al modello di estrapolare ben oltre la sua lunghezza di addestramento di 512 token, gestendo sequenze fino a 8.192 token senza degradazione delle prestazioni. Il processo di addestramento ha coinvolto due fasi chiave: pre-addestramento iniziale sul set di dati C4, seguito da un perfezionamento sulla raccolta curata di Jina AI di oltre 40 set di dati specializzati. Questi dati di addestramento diversificati, inclusi esempi negativi impegnativi e coppie di frasi varie, garantiscono prestazioni robuste in diversi domini e casi d'uso. Il modello produce vettori densi a 768 dimensioni che catturano relazioni semantiche sfumate, ottenute con parametri relativamente modesti di 137 milioni.

Prestazione

Nei test nel mondo reale, Jina Embeddings v2 Base English dimostra capacità eccezionali in più benchmark. Supera text-embedding-ada-002 di OpenAI in diverse metriche chiave: classificazione (73,45% contro 70,93%), riclassificazione (85,38% contro 84,89%), recupero (56,98% contro 56,32%) e riepilogo (31,6% contro 30,8%). Questi numeri si traducono in vantaggi pratici in attività come la classificazione dei documenti, in cui il modello mostra una capacità superiore di categorizzare testi complessi, e nelle applicazioni di ricerca, in cui comprende meglio le query degli utenti e trova documenti pertinenti. Tuttavia, gli utenti devono tenere presente che le prestazioni possono variare quando si ha a che fare con contenuti altamente specializzati specifici del dominio non rappresentati nei dati di training.

Orientamento

Per implementare efficacemente Jina Embeddings v2 Base English, i team devono considerare diversi aspetti pratici. Il modello richiede hardware compatibile con CUDA per prestazioni ottimali, sebbene la sua architettura efficiente ne consenta l'esecuzione su GPU di livello consumer. È disponibile tramite diversi canali: download diretto da Hugging Face, distribuzione su AWS Marketplace o API Jina AI con 10 milioni di token gratuiti. Per le distribuzioni di produzione, AWS SageMaker nella regione us-east-1 offre la soluzione più scalabile. Il modello eccelle nell'analisi testuale di tipo generale, ma potrebbe non essere la scelta migliore per terminologia scientifica altamente specializzata o gergo specifico di un dominio senza una messa a punto precisa. Quando si elaborano documenti lunghi, si consiglia di suddividerli in blocchi semantici significativi anziché in suddivisioni arbitrarie per mantenere l'integrità del contesto. Per risultati ottimali, implementare una corretta pre-elaborazione del testo e garantire dati di input puliti e ben formattati.

Blog che menzionano questo modello