Доступно через

Выберите модели для сравнения

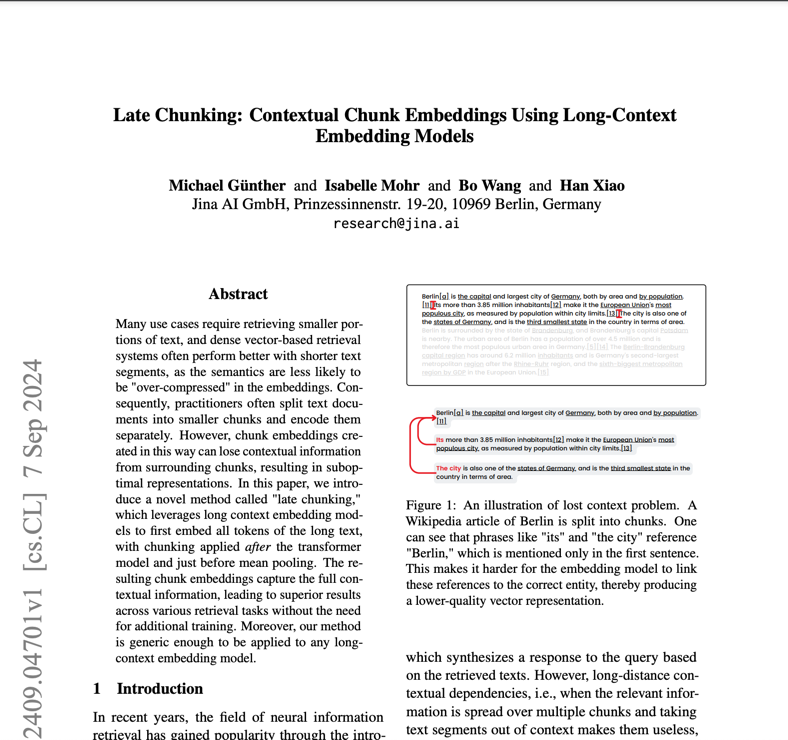

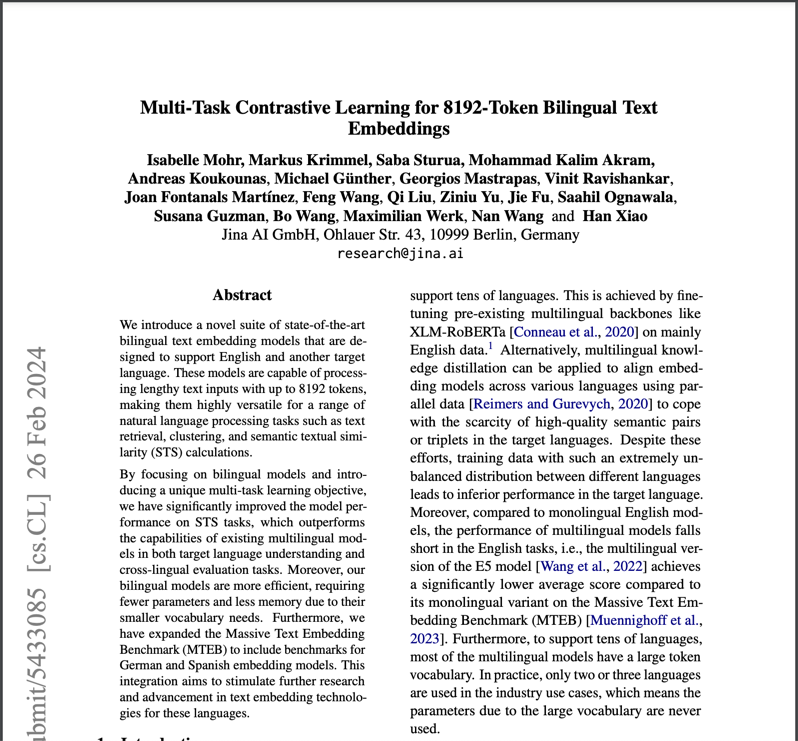

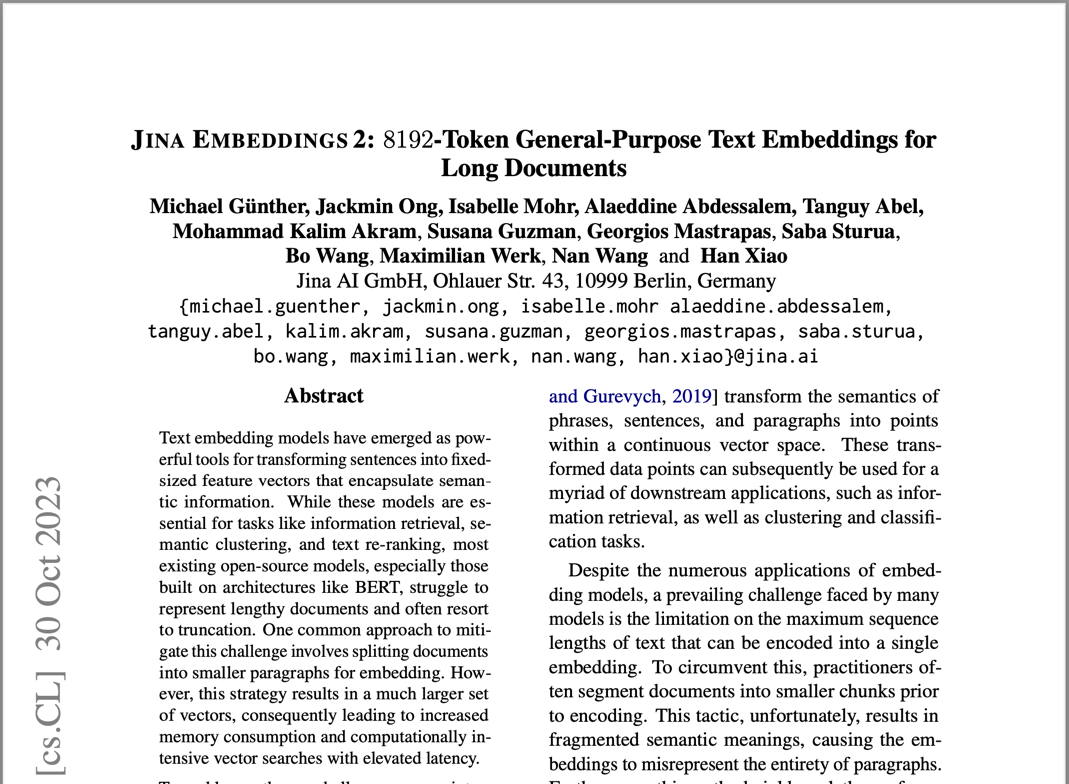

Публикации (3)

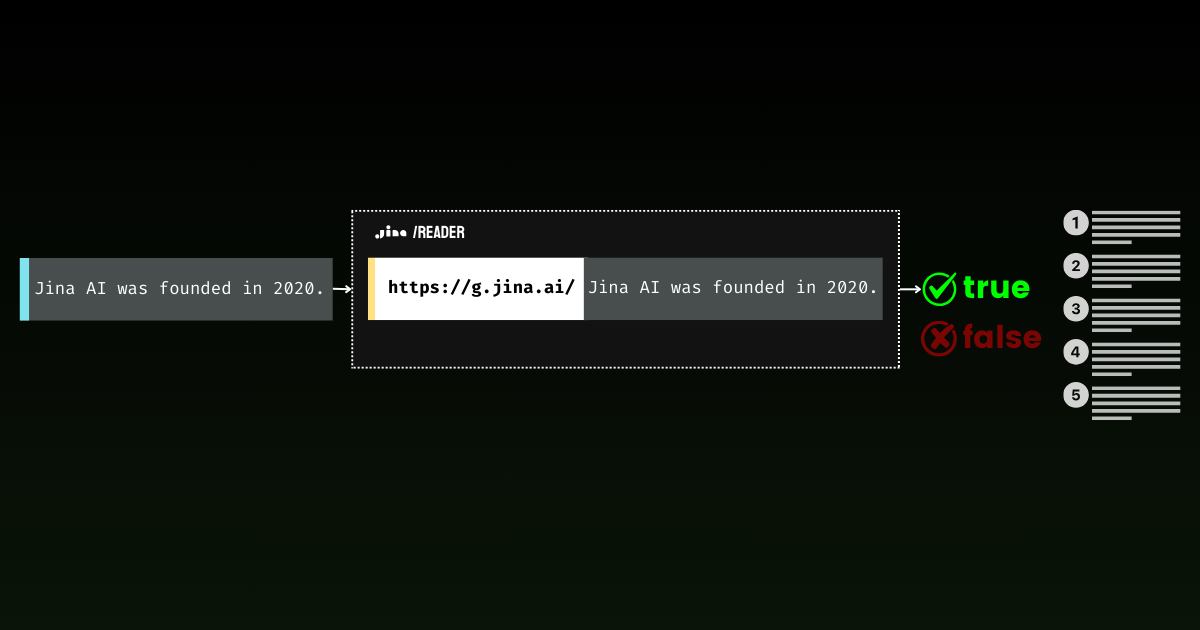

Обзор

Jina Embeddings v2 Base English — это новаторская модель встраивания текста с открытым исходным кодом, которая решает критическую задачу обработки длинных документов, сохраняя при этом высокую точность. Организации, испытывающие трудности с анализом обширных юридических документов, исследовательских работ или финансовых отчетов, найдут эту модель особенно ценной. Она выделяется тем, что обрабатывает документы длиной до 8192 токенов — в 16 раз больше, чем традиционные модели — и при этом соответствует производительности фирменных решений OpenAI. Благодаря компактному размеру 0,27 ГБ и эффективному использованию ресурсов она предлагает доступное решение для групп, стремящихся реализовать расширенный анализ документов без чрезмерных вычислительных затрат.

Методы

Архитектура модели объединяет базовую модель BERT Small с инновационным симметричным двунаправленным механизмом ALiBi (Attention with Linear Biases), устраняя необходимость в традиционных позиционных встраиваниях. Этот архитектурный выбор позволяет модели экстраполировать далеко за пределы ее длины обучения в 512 токенов, обрабатывая последовательности до 8192 токенов без ухудшения производительности. Процесс обучения включал два ключевых этапа: первоначальное предварительное обучение на наборе данных C4, за которым следовало уточнение на курируемой коллекции Jina AI из более чем 40 специализированных наборов данных. Эти разнообразные данные обучения, включая сложные отрицательные примеры и разнообразные пары предложений, обеспечивают надежную производительность в различных областях и вариантах использования. Модель создает 768-мерные плотные векторы, которые фиксируют тонкие семантические отношения, достигаемые с помощью относительно скромных 137M параметров.

Производительность

В реальных тестах Jina Embeddings v2 Base English демонстрирует исключительные возможности в нескольких бенчмарках. Он превосходит text-embedding-ada-002 от OpenAI по нескольким ключевым показателям: классификация (73,45% против 70,93%), переранжирование (85,38% против 84,89%), поиск (56,98% против 56,32%) и резюмирование (31,6% против 30,8%). Эти цифры транслируются в практические преимущества в таких задачах, как классификация документов, где модель демонстрирует превосходную способность категоризировать сложные тексты, и в поисковых приложениях, где она лучше понимает запросы пользователей и находит релевантные документы. Однако пользователи должны учитывать, что производительность может меняться при работе с узкоспециализированным доменно-специфическим контентом, не представленным в обучающих данных.

Руководство

Для эффективного развертывания Jina Embeddings v2 Base English командам следует учесть несколько практических аспектов. Для оптимальной производительности модели требуется оборудование с поддержкой CUDA, хотя ее эффективная архитектура означает, что она может работать на графических процессорах потребительского уровня. Она доступна по нескольким каналам: прямая загрузка с Hugging Face, развертывание AWS Marketplace или API Jina AI с 10 млн бесплатных токенов. Для производственных развертываний AWS SageMaker в регионе us-east-1 предлагает наиболее масштабируемое решение. Модель отлично подходит для анализа текста общего назначения, но может быть не лучшим выбором для узкоспециализированной научной терминологии или жаргона, специфичного для предметной области, без тонкой настройки. При обработке длинных документов рассмотрите возможность разбиения их на осмысленные семантические фрагменты, а не на произвольные разделения, чтобы сохранить целостность контекста. Для достижения оптимальных результатов реализуйте надлежащую предварительную обработку текста и обеспечьте чистые, хорошо отформатированные входные данные.

Блоги, в которых упоминается эта модель