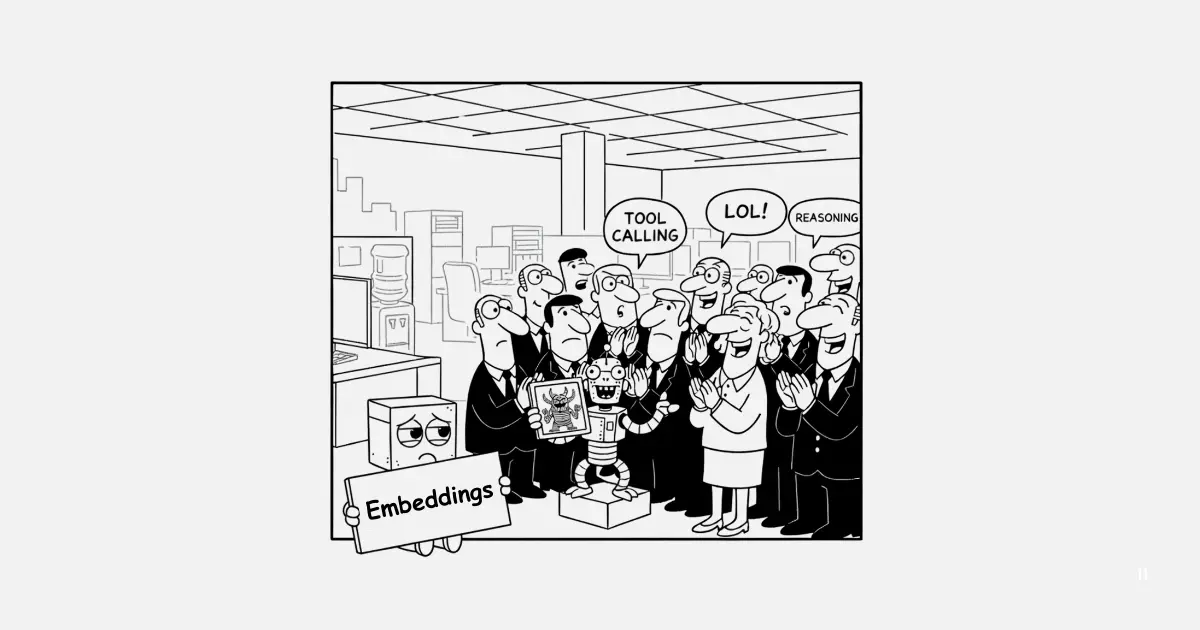

Vektor-Modelle sind das Aschenputtelkind der KI. Sie sind weder so aufregend wie die Bilderzeugung, noch so aufsehenerregend wie LLM-Chatbots, noch so apokalyptisch wie Vorhersagen über künstliche Superintelligenz. Semantische Vektor-Modelle sind esoterisch und technisch, und normale Verbraucher haben keinen direkten Nutzen von ihnen.

Vektor-Modelle sind Vektoren, die Semantik in geometrische Beziehungen in hochdimensionalen Räumen übersetzen. Aber versuche, das jemandem zu sagen, der nicht damit arbeitet, und beobachte, wie seine Augen vor Langeweile glasig werden.

Das bedeutet nicht, dass sie nicht wichtig oder gar revolutionär sind. Die Darstellung der Semantik von Texten als Vektoren in hochdimensionalen Räumen gibt es schon seit den 1950er Jahren, aber neuronale Netze mit Transformer-Architekturen haben sie auf Sprache, Bilder, Videos und so ziemlich jede Art von digitalen Daten ausgeweitet. Die qualitativen Verbesserungen der Computersemantik im letzten Jahrzehnt waren transformativ, und die Auswirkungen auf Suchmaschinen, Empfehlungsalgorithmen, automatisierte Klassifikatoren und Entscheidungssysteme waren enorm, auch wenn sie es nur selten in die Nachrichten schaffen.

Eine Sache, die bei dieser wenig beachteten Revolution übersehen wird, ist, dass die meisten neuronalen Netze, einschließlich der neueren Transformer-basierten, implizit Vektor-Modelle sind. Große Sprachmodelle, generative Bildmodelle und maschinelle Übersetzungssysteme funktionieren alle, indem sie ihre Eingaben in hochdimensionale Vektorräume übersetzen, die ihre wesentliche Semantik bewahren – d. h. Vektor-Modelle erstellen – und diese dann verwenden, um eine Ausgabe zu erzeugen. Diese Modelle können ohne Weiteres für die Generierung von Vektor-Modellen für die Informationsbeschaffung und andere Zwecke umfunktioniert werden.

In diesem Artikel werden wir die wichtigsten Fragen im Zusammenhang mit der Verwendung generativer Sprachmodelle (z. B. LLMs) zur Erzeugung von Text-Vektor-Modellen erörtern und wie wir diese Arbeit zur Verbesserung unserer Modelle nutzen.

tagEncoder und Decoder

Die Begriffe „Encoder“ und „Decoder“ werden in der KI-Modellentwicklung häufig verwendet, aber oft auf sehr verwirrende Weise. Die Begriffe beziehen sich auf Konzepte aus der Elektrotechnik und der Informationstheorie und gehen auf eine Zeit zurück, als neuronale Netze eher theoretisch als praktisch waren.

In ihrer ursprünglichen Konzeption wandelt ein Encoder seine Eingabe in eine maschinell nutzbare Form um, und ein Decoder tut das Gegenteil und wandelt Daten in etwas für den Menschen Nützlicheres um. Wenn das sehr abstrakt erscheint, dann liegt das daran, dass es das auch ist. Um zu helfen, wollen wir uns einige konkrete Beispiele ansehen.

In der traditionellen digitalen Elektronik (nicht KI) ist ein Encoder ein Gerät, das eine reichhaltige Eingangsquelle, wie z. B. ein analoges Geräusch, das von einem Mikrofon aufgenommen wurde, in eine binäre Sequenz umwandelt, die im Computerspeicher, auf physischen digitalen Medien gespeichert oder über ein digitales Netzwerk wie das Internet übertragen werden kann.

Ein Großteil der frühen Arbeit, die zu Vektor-Modellen und generativer KI führte, fand im Bereich der maschinellen Übersetzung statt, wo die grundlegende Architektur diesem Bild sehr nahe kam.

Man kann ein Vektor-Modell als nur die „Encoder“-Hälfte eines Encoder-Decoder-Modells für maschinelle Übersetzung betrachten, mit einem zusätzlichen Adapter zur Erzeugung von Vektoren für das Vektor-Modell.

Und man kann ein generatives Modell als nur die „Decoder“-Hälfte betrachten:

Es kann sehr kontraintuitiv sein, über neuronale Netzwerkmodelle auf diese Weise nachzudenken. Die Beziehung zwischen Datenmodellierung, Semantik und Kompression ist kompliziert und sehr abstrakt, aber sie ist wichtig für unser Verständnis von KI-Modellen. Der Unterschied zwischen Encoder- und Decodermodellen liegt in der Art und Weise, wie sie verwendet werden, nicht in ihrer Architektur.

tagTransformer-basierte Encoder und Decoder sind gleich

Encoder und Decoder sind ziemlich abstrakte Konzepte, aber wenn wir über Transformer-basierte Modelle sprechen, haben sie beide fast identische Architekturen.

Die folgenden Beispiele sind bezeichnend für generative Sprachmodelle und Text-Vektor-Modelle, aber mit einigen kleinen Änderungen gilt das Gleiche auch für andere Medientypen.

Sowohl Encoder- als auch Decoder-Modelle nehmen Texte als Eingabe entgegen und wenden Tokenisierung und dann Vektorisierung an – im Wesentlichen werden die Token in einem Wörterbuch nachgeschlagen und für jedes Token der entsprechende Vektor eingesetzt – und fügen dann gegebenenfalls Padding hinzu. Das Ergebnis ist ein Eingangsvektor fester Länge für den Rest des Modells.

In einem reinen Decoder-basierten generativen Sprachmodell wird dieser Eingangsvektor an ein Transformer-Modell und dann an einen Decoder-Adapter weitergeleitet, der seine Ausgabe in ein oder mehrere Token umwandelt. Textgenerierende Modelle hängen diese neuen Token dann an die Eingabe an und führen sie erneut aus, um weitere Token hinzuzufügen.

Fast das gesamte Bild wird mit Transformer-basierten Text-Vektor-Architekturen geteilt, mit der Ausnahme, dass anstelle eines Decoder-Apparats, der Token erzeugt, ein Encoder-Apparat ein Vektor-Modell erzeugt.

Die Hauptunterschiede zwischen den beiden liegen nicht grundsätzlich in der Architektur, sondern in der Art und Weise, wie sie trainiert und eingesetzt werden.

Generative Sprachmodelle sind in der Regel unidirektional (oder „kausal“): Sie erzeugen das nächste Token, indem sie nur das vorherige Token betrachten. Vektor-Modelle sind in der Regel bidirektional (oder „nicht-kausal“).

Dies wirkt sich auf die Art und Weise aus, wie sie trainiert werden. Das Training generativer Modelle spiegelt dies wider, indem es aus Textmengen lernt, die ihm jeweils ein Token übergeben werden. Vektor-Modelle werden in der Regel mit „Masked Language Modeling“-Techniken (MLM) vortrainiert, was bedeutet, dass sie sich die Wörter sowohl vor als auch nach einer Lücke ansehen, um eine semantische Darstellung des fehlenden Wortes zu erstellen.

Nichtsdestotrotz bedeutet die Umwandlung eines generativen LLM in ein Vektor-Modell im Prinzip nur, dass der Decoder-Apparat durch einen Encoder ersetzt und für den neuen Zweck feinabgestimmt wird.

Warum tun wir das also nicht?

tagTransformer-basierte Encoder und Decoder sind unterschiedlich

Forscher haben drei wichtige Gründe genannt, generative Sprachmodelle nicht in Text-Vektor-Modelle umzuwandeln, aber jeder einzelne wurde in letzter Zeit in Frage gestellt.

Bidirektionale („nicht-kausale“) Aufmerksamkeit ist besser als unidirektionale („kausale“) Aufmerksamkeit.

Seit dem bahnbrechenden BERT-Modell haben wir es als selbstverständlich angesehen, dass bidirektionale Aufmerksamkeit besser ist als unidirektionale, einfach weil mehr Informationen verfügbar sind. Das Modell kann Token in ihrem vollen Kontext sehen, nicht nur im Kontext der vorhergehenden Wörter.

Neuere Studien (Wang et al. 2023, Gisserot-Boukhlef et al. 2025) legen jedoch nahe, dass es keinen großen Unterschied in den Ergebnissen zwischen bidirektionalem und unidirektionalem Vortraining gibt, obwohl es je nach den betrachteten Faktoren einige kleine Vorteile für jedes gibt.

Generative LLMs leiden unter dem Fluch der Dimensionalität, was sie schlecht in der Generalisierung macht.

LLMs sind nicht darauf ausgelegt, gute Vektor-Modelle zu sein. Ihre internen Vektordarstellungen – die verborgenen Schichten – haben typischerweise viel mehr Dimensionen als ein Vektor-Modell hätte. Die Modelle sind zu groß, und sie können bei der Generalisierung scheitern, weil ein großer semantischer Raum keine kompakten Darstellungen enthalten muss.

Dieses Problem wird manchmal als Fluch der Dimensionalität bezeichnet, und es plagt neuronale Netze.

Im Gegensatz zu Vektor Modelle werden generative Sprachmodelle nach einer Kurve bewertet. Generative Modelle verwenden diese internen Vektor Modell nicht direkt; sie verwenden die Sprache, die aus der Rückverwandlung in Token entsteht. Wenn das Modell flüssig und kohärent zu sprechen scheint, bewerten wir es hoch. Vektor Modelle hingegen haben tatsächliche Aufgaben zu erfüllen, die eine korrekte Verallgemeinerung erfordern. Der Fluch der Dimensionalität scheint also für generative Modelle nicht so wichtig zu sein, ist aber für ein Vektor Modell tödlich.

In letzter Zeit haben generative Sprachmodelle jedoch einen Teil des Fluchs der Dimensionalität abgeschüttelt. Leistungsstarke generative kleine Sprachmodelle (SLMs) mit weniger als 10 Milliarden Parametern sind heute weit verbreitet, und obwohl sie eher durch den Wunsch nach kleineren, effizienteren Sprachmodellen motiviert sind als durch ein Interesse an Vektor Modelle, können wir sie dennoch nutzen, um bessere Modelle zu bauen.

Die Leute haben es bereits versucht, und es hat nicht sehr gut funktioniert.

Die Dualität von Vektor Modelle und generativen Modellen ist nicht neu, aber von generativen Modellen abgeleitete Vektor Modelle waren typischerweise viel größer als vergleichbar leistungsfähige Vektor Modelle. OpenAI passte GPT-3 im Jahr 2022 für Vektor Modelle an, aber trotz etwa 175 Milliarden Parametern erreicht es etwa die gleiche Leistung wie MLM-trainierte Vektor Modelle mit unter einer Milliarde Parametern.

Die NV-Embed-Modellfamilie, die NVIDIA von dem 7-Milliarden-Parameter Mistral-7B SLM adaptiert hat, hat jedoch eine hochmoderne Leistung bei Standard-Vektor Modell-Benchmarks erzielt. Dies ist Beweis genug dafür, dass die Anpassung generativer Sprachmodelle in der Praxis recht gut funktionieren kann.

tagVorteile der Anpassung generativer Modelle

Die Wiederverwendung von generativen Sprachmodellen im Decoder-Stil für Vektor Modelle im Encoder-Stil hat möglicherweise keine Nachteile, aber es scheint auch keine Vorteile zu haben, zumindest auf dem Papier. In der Praxis gibt es jedoch einige greifbare Vorteile.

Erstens stehen generative Sprachmodelle im Mittelpunkt vieler Forschung und Gelder, weil sie der aufregende Teil der KI sind. Vektor Modelle, die von ihnen adaptiert werden, können diese zusätzliche Aufmerksamkeit und Anstrengung ohne zusätzliche Kosten in Anspruch nehmen. Die Entwicklung und das Training eines neuen Vektor Modells von Grund auf ist eine teure Angelegenheit im Vergleich zu dem kontrastiven Fine-Tuning, das zur Optimierung eines vortrainierten Modells verwendet wird, so dass dieser rein wirtschaftliche Vorteil ziemlich bedeutend ist.

Als Beispiel sind unsere kürzlich veröffentlichten Modelle jina-code-embeddings-1.5b und jina-code-embeddings-0.5b die ersten Code-Vektor Modelle, die auf Code-Generierungs-Backbones basieren, insbesondere Qwen2.5-Coder-1.5B und Qwen2.5-Coder-0.5B. Wir haben ihre Vektor Modell-Leistung erheblich verbessert, weil wir unsere ganze Aufmerksamkeit auf das Training für gute Vektor Modelle richten konnten, anstatt ein komplexes und kostspieliges Vortraining durchzuführen.

Zweitens ist es möglich, die Fähigkeiten generativer Modelle auf neue Bereiche zu übertragen.

Das Modell jina-embeddings-v4 tut genau das. Es adaptiert Qwen2.5-VL-3B-Instruct, ein 3,8 Milliarden Parameter umfassendes Vision-Language-Modell, für multimodale Vektor Modelle. Seine außergewöhnliche Leistung als Vektor Modell für Diagramme, Screenshots und andere visuelle Dokumentbild-Eingaben beruht auf den bereits vorhandenen Fähigkeiten des generativen Modells zum Verständnis natürlicher Sprache. Anstatt ein Modell von Grund auf zu trainieren, um zuerst Sprache zu verstehen, dann gedruckten Text in Bildern zu analysieren und schließlich gute Vektor Modelle zu erstellen, konnten wir Wissen von einem bereits vorhandenen Bild-Vektor Modell und einem generativen Sprachmodell übertragen und uns stattdessen auf das kontrastive Training für Vektor Modell-Aufgaben konzentrieren.

tagVektor Modelle erledigen die Arbeit

Unter sonst gleichen Bedingungen gibt es keinen klaren Vorteil, generative Sprachmodelle als Rückgrat für ein Vektor Modell zu verwenden. Wenn Sie ein Text-Vektor Modell von Grund auf neu erstellen müssen, scheint es keinen großen Unterschied zu machen, ob Sie bidirektionales oder unidirektionales Vortraining verwenden. Investitionen in Datenqualität, Aufgabenspezialisierung und Feinabstimmung für die Vektor Modell-Qualität zählen viel mehr.

Aber alles andere ist nicht gleich.

Vektor Modelle erhalten bei weitem nicht die gleichen Mittel wie generative Sprachmodelle, und die Verwendung ihrer Modelle als unser Rückgrat ermöglicht es uns, mehr Aufwand in die Entwicklung besserer Vektor Modelle zu stecken, da sie ihre Ressourcen für ihr Vortraining eingesetzt haben.

Vektor Modelle stehen vor besonderen Problemen, weil sie nicht die beeindruckenden Demos haben, für die generative KI so berühmt ist. Stattdessen haben sie wichtige, tatsächlich existierende Anwendungsfälle, bei denen Genauigkeit, Qualität und Kosten alles zählen. Informationsabruf, Klassifizierungsaufgaben, Empfehlungssysteme, Spam- und Betrugserkennung und Inhaltsmoderation — all dies sind tatsächliche Aufgaben, die Vektor Modelle jetzt erledigen.

Vektor Modelle sind nicht so aufregend, aber sie erledigen die Arbeit. Wenn wir also ein wenig von der besser finanzierten Arbeit von der aufregenden Seite der KI auf ihre ungeliebten Stiefkinder umleiten können, scheint das fair genug zu sein.