Es ist schwer zu sagen, ob die Menschen RAG hassen zu lieben oder lieben zu hassen.

Nach aktuellen Diskussionen auf X und HN, sollte RAG tot sein, wieder einmal. Diesmal konzentriert sich die Kritik auf das Over-Engineering der meisten RAG-Frameworks, was, wie @jeremyphoward @HamelHusain @Yampeleg demonstrierten, mit 20 Zeilen Python-Code erreicht werden könnte.

Das letzte Mal hatten wir diese Stimmung kurz nach der Veröffentlichung von Claude/Gemini mit einem sehr langen Kontextfenster. Was es diesmal schlimmer macht, ist, dass sogar Googles RAG lustige Ergebnisse generiert, wie @icreatelife @mark_riedl zeigten, was ironisch ist, da Google im April auf der Google Next in Las Vegas RAG als Grounding-Lösung präsentierte.

tagZwei Probleme von RAG

Ich sehe zwei Probleme bei den RAG-Frameworks und Lösungen, die wir heute haben.

tagNur Feed-Forward

Erstens implementieren fast alle RAG-Frameworks nur einen "Feed-Forward"-Pfad und haben keinen "Back-Propagation"-Pfad. Es ist ein unvollständiges System. Ich erinnere mich, dass @swyx in einer der Episoden von @latentspacepod argumentierte, dass RAG nicht durch das lange Kontextfenster von LLMs getötet werden wird, da:

- langer Kontext für Entwickler teuer ist und

- langer Kontext schwer zu debuggen ist und keine Zerlegbarkeit bietet.

Aber wenn sich alle RAG-Frameworks nur auf den Vorwärtspfad konzentrieren, wie ist es dann einfacher zu debuggen als ein LLM? Es ist auch interessant, wie viele Menschen von den automatisch-magischen Ergebnissen von RAG aus einigen zufälligen POCs überbegeistert sind und völlig vergessen, dass das Hinzufügen weiterer Vorwärtsschichten ohne Rückwärts-Tuning eine schreckliche Idee ist. Wir alle wissen, dass das Hinzufügen einer weiteren Schicht zu Ihren neuronalen Netzen deren parametrischen Raum und damit die Darstellungsfähigkeit erweitert und es ermöglicht, mehr potenzielle Dinge zu tun, aber ohne Training ist das nichts. Es gibt einige Startups im Bay Area, die an Evaluation arbeiten – im Wesentlichen versuchen sie, den Verlust eines Feed-Forward-Systems zu bewerten. Ist es nützlich? Ja. Aber hilft es, die Schleife von RAG zu schließen? Nein.

Wer arbeitet also an der Back-Propagation von RAG? Soweit ich weiß, nicht viele. Ich kenne hauptsächlich DSPy, eine Bibliothek von @stanfordnlp @lateinteraction, die sich diese Mission gesetzt hat.

Aber selbst bei DSPy liegt der Hauptfokus auf der Optimierung von Few-Shot-Demonstrationen, nicht auf dem Gesamtsystem (oder zumindest nach der Community-Nutzung). Aber warum ist dieses Problem schwierig? Weil das Signal sehr spärlich ist und die Optimierung eines nicht-differenzierbaren Pipeline-Systems im Wesentlichen ein kombinatorisches Problem ist – mit anderen Worten, extrem schwierig. Ich habe während meiner Promotion einiges über submodulare Optimierung gelernt, und ich habe das Gefühl, dass diese Technik bei der RAG-Optimierung gut zum Einsatz kommen wird.

tagGrounding in freier Wildbahn ist schwierig

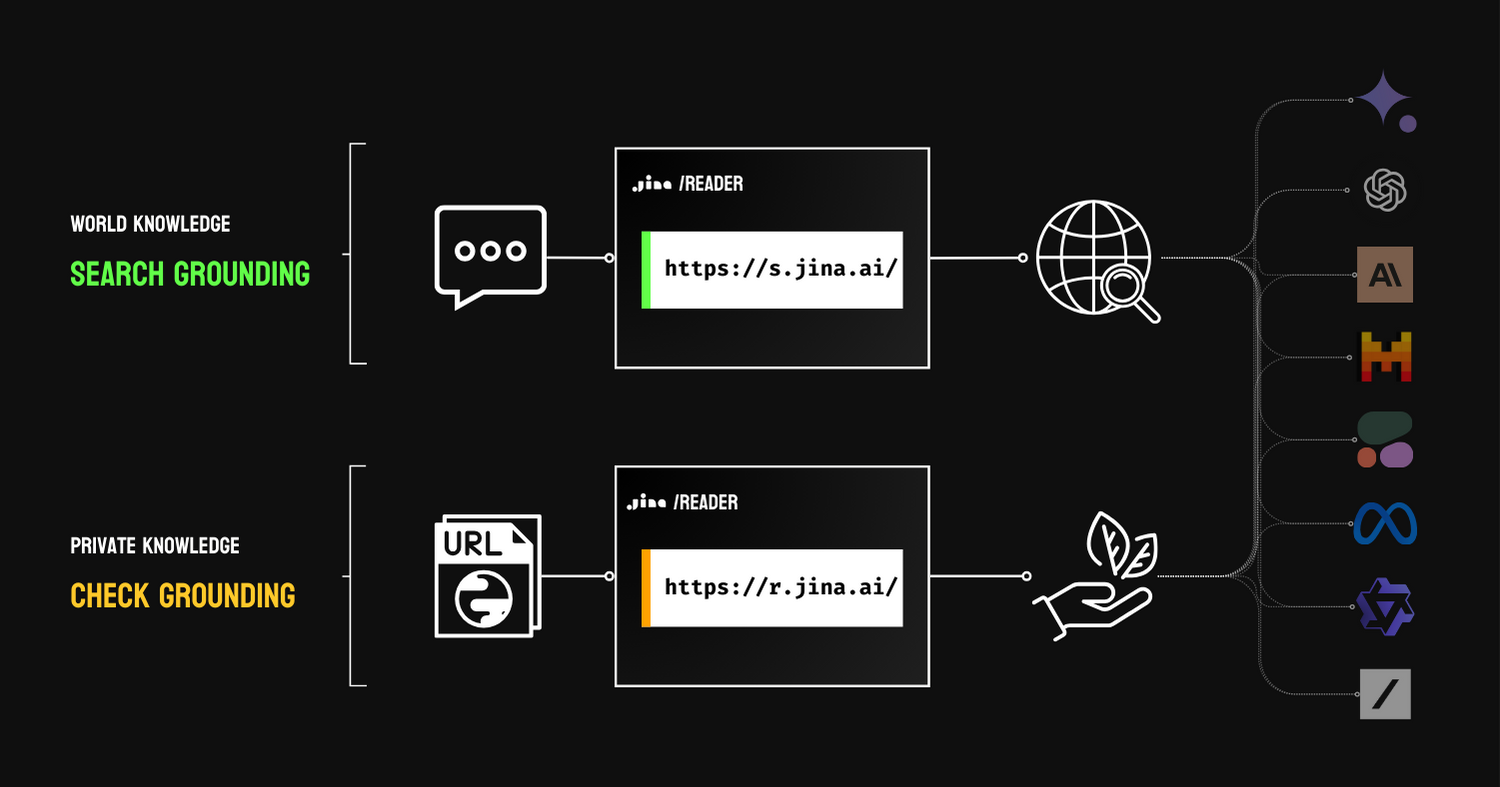

Ich stimme zu, dass RAG für Grounding ist, trotz der lustigen Suchergebnisse von Google. Es gibt zwei Arten von Grounding: Search Grounding, das Suchmaschinen verwendet, um das Weltwissen von LLMs zu erweitern, und Check Grounding, das privates Wissen (z.B. proprietäre Daten) für Faktenprüfung nutzt.

In beiden Fällen werden externe Quellen zitiert, um die Faktizität des Ergebnisses zu verbessern, vorausgesetzt, diese externen Ressourcen sind vertrauenswürdig. Bei Googles lustigen Suchergebnissen kann man leicht erkennen, dass nicht alles im Web vertrauenswürdig ist (ja, große Überraschung, wer hätte das gedacht!), was Search Grounding schlecht aussehen lässt. Aber ich glaube, man kann darüber jetzt nur lachen. Es gibt einige implizite Feedback-Mechanismen hinter der Google Search UI, die die Reaktionen der Nutzer auf diese Ergebnisse sammeln und die Glaubwürdigkeit der Website für besseres Grounding gewichten. Im Allgemeinen sollte es ziemlich vorübergehend sein, da dieses RAG nur den Kaltstart überstehen muss, und die Ergebnisse werden sich mit der Zeit verbessern.

RAG wurde auf der Google Next Konferenz als Grounding-Lösung vorgestellt.

tagMeine Meinung

RAG ist weder tot noch lebendig; hört also auf, darüber zu streiten. RAG ist einfach nur ein algorithmisches Muster, das man nutzen kann. Aber wenn Sie es zu dem Algorithmus machen und es vergöttern, dann leben Sie in einer selbst erschaffenen Blase, die platzen wird.