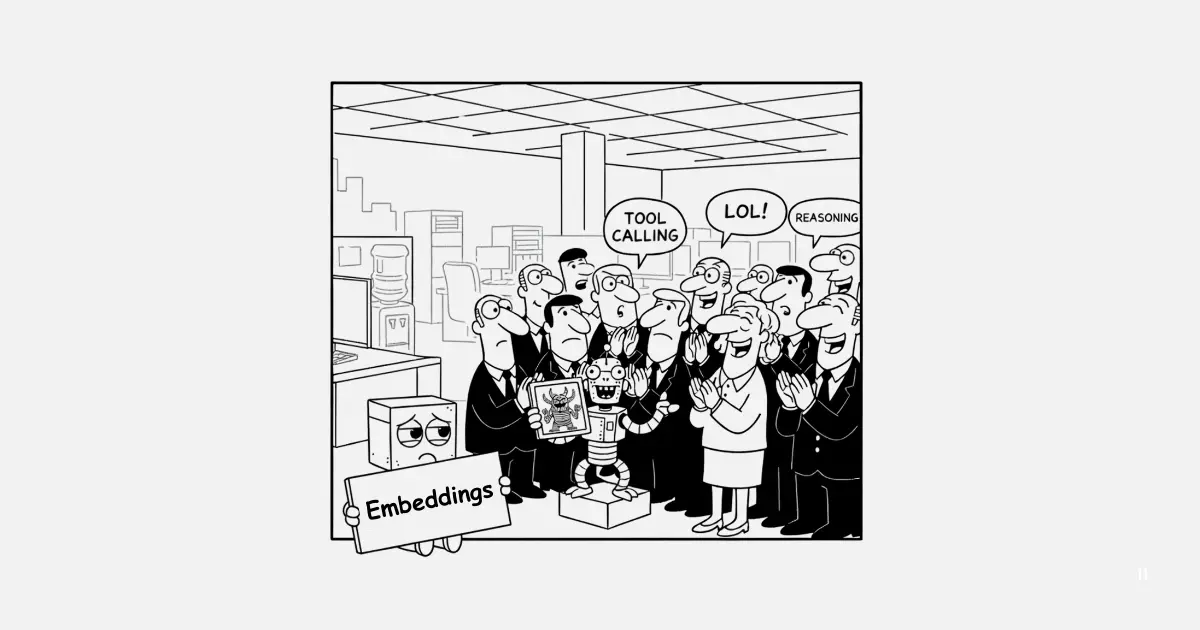

Los modelos de 向量模型 son el pariente pobre de la IA. No son tan atractivos como la generación de imágenes, ni tan llamativos como los chatbots de 大模型, ni tan apocalípticos como las predicciones de la superinteligencia artificial. Los 向量模型 semánticos son esotéricos y técnicos, y los consumidores habituales no les dan mucho uso directo.

Los 向量模型 son vectores que traducen la semántica en relaciones geométricas en espacios de alta dimensión. Pero intente decírselo a alguien que no trabaje con ellos y observe cómo se aburren.

Eso no significa que no sean importantes, o incluso revolucionarios. Representar la semántica de los textos como vectores en espacios de alta dimensión existe desde la década de 1950, pero las redes neuronales con arquitecturas de transformadores lo han ampliado al habla, las imágenes, el vídeo y casi cualquier tipo de datos digitales. Las mejoras cualitativas en la semántica computacional en la última década han sido transformadoras, y las implicaciones para los motores de búsqueda, los algoritmos de recomendación, los clasificadores automatizados y los sistemas de decisión han sido enormes, incluso si rara vez aparecen en las noticias.

Una cosa que se pasa por alto en esta revolución poco divulgada es que la mayoría de las redes neuronales, incluidas las recientes basadas en transformadores, son implícitamente modelos de 向量模型. Los modelos de lenguaje grandes, los modelos generativos de imágenes y los sistemas de traducción automática funcionan traduciendo sus entradas en espacios vectoriales de alta dimensión que conservan su semántica esencial —es decir, crean 向量模型— y luego utilizan eso para producir una salida. Estos modelos pueden reutilizarse fácilmente para generar 向量模型 para la recuperación de información y otros fines.

En este artículo, analizaremos los principales problemas relacionados con el uso de modelos de lenguaje generativos (por ejemplo, 大模型) para producir 向量模型 de texto y cómo estamos utilizando este trabajo para mejorar nuestros modelos.

tagCodificadores y decodificadores

Los términos "codificador" y "decodificador" se utilizan mucho en el desarrollo de modelos de IA, pero a menudo de formas muy confusas. Los términos se relacionan con conceptos de ingeniería eléctrica y teoría de la información, y se remontan a una época en la que las redes neuronales eran más teóricas que prácticas.

En su concepción original, un codificador convierte su entrada en una forma utilizable por la máquina, y un decodificador hace lo contrario, convirtiendo los datos en algo más útil para los humanos. Si esto le parece muy abstracto, es porque lo es. Para ayudarle, veamos algunos ejemplos concretos.

En la electrónica digital tradicional (no en la IA), un codificador es un dispositivo que convierte una fuente de entrada rica, como un sonido analógico capturado por un micrófono, en una secuencia binaria que puede almacenarse en la memoria del ordenador, en medios digitales físicos o transmitirse a través de una red digital como Internet.

Gran parte del trabajo inicial que condujo a los modelos de 向量模型 y a la IA generativa se realizó en la traducción automática, donde la arquitectura básica coincidía estrechamente con esta imagen.

Puede considerar un modelo de 向量模型 como sólo la mitad del "codificador" de un modelo de traducción automática codificador-decodificador, con un adaptador añadido para producir vectores de 向量模型.

Y puede considerar un modelo generativo como sólo la mitad del "decodificador":

Puede ser muy contraintuitivo pensar en los modelos de redes neuronales de esta manera. La relación entre el modelado de datos, la semántica y la compresión es complicada y muy abstracta, pero es importante para cómo entendemos los modelos de IA. La diferencia entre los modelos de codificador y decodificador radica en cómo se utilizan, no en su arquitectura.

tagLos codificadores y decodificadores basados en transformadores son iguales

Los codificadores y decodificadores son conceptos bastante abstractos, pero si hablamos de modelos basados en transformadores, ambos tienen arquitecturas casi idénticas.

Los ejemplos siguientes son indicativos de modelos de lenguaje generativos y modelos de 向量模型 de texto, pero con algunos pequeños cambios, lo mismo se aplica a otros tipos de medios.

Tanto los modelos de sólo codificador como los de sólo decodificador toman textos como entrada y aplican la tokenización y luego la vectorización, esencialmente buscando los tokens en un diccionario y sustituyendo el vector apropiado para cada uno, y luego añadiendo el relleno según corresponda. El resultado es un vector de entrada de longitud fija para el resto del modelo.

En un modelo de lenguaje generativo de sólo decodificador, este vector de entrada se pasa a un modelo de transformador y luego a un adaptador de decodificador que transforma su salida en uno o más tokens. Los modelos de generación de texto añaden entonces estos nuevos tokens a la entrada y vuelven a ejecutarse para añadir más tokens.

Casi toda esta imagen se comparte con las arquitecturas de 向量模型 de texto basadas en transformadores, excepto que en lugar de que un aparato decodificador produzca tokens, un aparato codificador produce un 向量模型.

Las principales diferencias entre ambos no son fundamentalmente arquitectónicas, sino en cómo se entrenan y se utilizan.

Los modelos de lenguaje generativos suelen ser unidireccionales (o "causales"): Generan el siguiente token mirando sólo al token anterior. Los modelos de 向量模型 suelen ser bidireccionales (o "no causales").

Esto afecta a cómo se entrenan. El entrenamiento del modelo generativo refleja esto, aprendiendo de cantidades de texto, que se le pasan un token a la vez. Los modelos de 向量模型 suelen ser pre-entrenados utilizando técnicas de "modelado de lenguaje enmascarado" (MLM), lo que significa que miran las palabras tanto antes como después de un hueco para generar una representación semántica de la palabra que falta.

No obstante, en principio, convertir un 大模型 generativo en un modelo de 向量模型 simplemente significa sustituir el aparato decodificador por un codificador y ajustarlo para el nuevo uso.

Entonces, ¿por qué no lo hacemos?

tagLos codificadores y decodificadores basados en transformadores son diferentes

Los investigadores han ofrecido tres grandes razones para no convertir los modelos de lenguaje generativos en modelos de 向量模型 de texto, pero cada una de ellas ha sido cuestionada últimamente.

La atención bidireccional ("no causal") es mejor que la atención unidireccional ("causal").

Desde el modelo seminal BERT, hemos dado por sentado que la atención bidireccional es mejor que la unidireccional simplemente porque hay más información disponible. El modelo puede ver los tokens en su contexto completo, no sólo en el contexto de las palabras precedentes.

Sin embargo, estudios más recientes (Wang et al. 2023, Gisserot-Boukhlef et al. 2025) sugieren que no hay una gran diferencia en los resultados entre el pre-entrenamiento bidireccional y el unidireccional, aunque hay algunas pequeñas ventajas para cada uno, dependiendo de los factores que se estén considerando.

Los 大模型 generativos sufren la maldición de la dimensionalidad, lo que los hace malos para la generalización.

Los 大模型 no están diseñados para ser buenos modelos de 向量模型. Sus representaciones vectoriales internas —las capas ocultas— suelen tener muchas más dimensiones de las que tendría un modelo de 向量模型. Los modelos son demasiado grandes y pueden no generalizar porque un espacio semántico grande no tiene por qué contener representaciones compactas.

Este problema a veces se denomina la maldición de la dimensionalidad, y afecta a las redes neuronales.

A diferencia de los 向量模型, los modelos de lenguaje generativos se evalúan en una curva. Los modelos generativos no utilizan esos vectores de 向量模型 internos directamente; utilizan el lenguaje que proviene de transformarlos de nuevo en 词元. Si el modelo parece hablar con fluidez y coherencia, lo clasificamos alto. Los modelos de 向量模型, por el contrario, tienen tareas reales que realizar que exigen una generalización correcta. Por lo tanto, la maldición de la dimensionalidad no parece tan importante para los modelos generativos, pero es letal para un modelo de 向量模型.

Recientemente, sin embargo, los modelos de lenguaje generativos se han sacudido parte de la maldición de la dimensionalidad. Los pequeños modelos de lenguaje generativos (SLM) de alto rendimiento con menos de 10 mil millones de parámetros son ahora bastante comunes, y aunque están motivados más por el deseo de tener modelos de lenguaje más pequeños y eficientes que por cualquier interés en los 向量模型, aún podemos aprovecharlos para construir mejores modelos.

La gente ya lo ha intentado y no ha funcionado muy bien.

La dualidad de los modelos de 向量模型 y los modelos generativos no es nueva, pero los modelos de 向量模型 adaptados de los generativos han sido típicamente mucho más grandes que los modelos de 向量模型 de rendimiento comparable. OpenAI adaptó GPT-3 para 向量模型 en 2022, pero, a pesar de tener aproximadamente 175 mil millones de parámetros, funciona aproximadamente a la par con los modelos de 向量模型 entrenados con MLM de menos de mil millones de parámetros.

Sin embargo, la familia de modelos NV-Embed, que NVIDIA adaptó del SLM Mistral-7B de 7 mil millones de parámetros, ha logrado un rendimiento de última generación en los puntos de referencia estándar de 向量模型. Esta es prueba suficiente de que la adaptación de modelos de lenguaje generativos puede funcionar bastante bien en la práctica.

tagBeneficios de adaptar modelos generativos

La reutilización de modelos de lenguaje generativos de estilo decodificador para 向量模型 de estilo codificador puede no tener desventajas, pero tampoco parece tener ninguna ventaja, al menos en teoría. Pero en la práctica, hay algunos beneficios tangibles.

Primero, los modelos de lenguaje generativos son el foco de mucha investigación y dinero porque son la parte atractiva de la IA. Los modelos de 向量模型 adaptados de ellos pueden apropiarse de esa atención y esfuerzo adicionales con poco costo adicional. Desarrollar y entrenar un nuevo modelo de 向量模型 desde cero es una operación costosa en comparación con el ajuste fino contrastivo utilizado para optimizar un modelo pre-entrenado, por lo que este beneficio puramente económico es bastante significativo.

Como ejemplo, nuestros modelos recientemente lanzados jina-code-embeddings-1.5b y jina-code-embeddings-0.5b son los primeros modelos de 向量模型 de código basados en backbones de generación de código, específicamente Qwen2.5-Coder-1.5B y Qwen2.5-Coder-0.5B, respectivamente. Mejoramos considerablemente su rendimiento de 向量模型 porque pudimos concentrar toda nuestra atención en entrenarlos para obtener buenos 向量模型 en lugar de hacer un pre-entrenamiento complejo y costoso.

Segundo, es posible transferir las capacidades de los modelos generativos a nuevos dominios.

El modelo jina-embeddings-v4 hace exactamente eso. Adapta Qwen2.5-VL-3B-Instruct, un modelo de visión-lenguaje de 3.8 mil millones de parámetros, para 向量模型 multimodales. Su excepcional rendimiento como modelo de 向量模型 para diagramas, capturas de pantalla y otras entradas de imágenes de documentos visuales se basa en las habilidades preexistentes de comprensión del lenguaje natural del modelo generativo. En lugar de entrenar un modelo desde cero primero para comprender el lenguaje, luego para analizar texto impreso en imágenes y finalmente para producir buenos 向量模型, pudimos transferir el conocimiento de un modelo de 向量模型 de imágenes preexistente y un modelo de lenguaje generativo, centrándonos en cambio en el entrenamiento contrastivo para tareas de 向量模型.

tagLos 向量模型 hacen el trabajo

En igualdad de condiciones, no hay una ventaja clara en el uso de modelos de lenguaje generativos como la columna vertebral de un modelo de 向量模型. Si tiene que construir un modelo de 向量模型 de texto desde cero, no parece importar mucho si utiliza un pre-entrenamiento bidireccional o unidireccional. Invertir en la calidad de los datos, la especialización de tareas y el ajuste fino para la calidad de los 向量模型 cuenta mucho más.

Pero no todo lo demás es igual.

Los modelos de 向量模型 no ven nada parecido a la financiación que obtienen los modelos de lenguaje generativos, y el uso de sus modelos como nuestros backbones nos permite dedicar más esfuerzo a hacer mejores modelos de 向量模型 debido a los recursos que dedicaron a su pre-entrenamiento.

Los 向量模型 enfrentan problemas especiales porque no tienen las demostraciones de aspecto impresionante por las que la IA generativa es tan famosa. En cambio, tienen casos de uso importantes y realmente existentes en los que la precisión, la calidad y el costo cuentan para todo. La recuperación de información, las tareas de clasificación, los sistemas de recomendación, la detección de spam y fraude y la moderación de contenido: todos son trabajos reales que los modelos de 向量模型 están haciendo ahora.

Los 向量模型 no son tan atractivos, pero hacen el trabajo. Entonces, si podemos reapropiarnos un poco del trabajo mejor financiado del lado atractivo de la IA para sus hijastros pelirrojos, eso parece bastante justo.