Il discorso sull'AI è spesso apocalittico. Parte della colpa è dovuta al modo in cui la fantascienza apocalittica ha creato la nostra immagine mentale dell'intelligenza artificiale. Le visioni di macchine intelligenti che possono creare altre macchine sono state un tema comune nella fantascienza per generazioni.

Molte persone si sono espresse sui rischi esistenziali degli recenti sviluppi dell'AI, molti di loro sono leader aziendali coinvolti nella commercializzazione dell'AI, e persino alcuni scienziati e ricercatori. È diventato un elemento dell'hype dell'AI: qualcosa abbastanza potente da far contemplare la fine del mondo a figure apparentemente sobrie della scienza e dell'industria deve sicuramente essere abbastanza potente da generare profitto, giusto?

Quindi, dovremmo preoccuparci dei rischi esistenziali dell'AI? Dobbiamo temere che Sam Altman creerà Ultron da ChatGPT e farà sì che il suo esercito di AI ci lanci contro città dell'Europa orientale? Dovremmo preoccuparci che Palantir di Peter Thiel stia costruendo Skynet e inviando robot con accenti austriaci inspiegabili indietro nel tempo per ucciderci?

Probabilmente no. I leader del settore devono ancora identificare un modo chiaro per far sì che l'AI paghi i propri conti, figuriamoci sconvolgere le industrie, e ancor meno minacciare l'umanità a un livello paragonabile al cambiamento climatico o alle armi nucleari.

I modelli di AI che abbiamo attualmente sono ben lontani dall'essere in grado di sterminare l'umanità. Faticano a disegnare le mani, non riescono a contare più di tre cose, pensano che sia accettabile vendere formaggio rosicchiato dai topi, e eseguono battesimi cattolici con il Gatorade. I rischi mondani e non esistenziali dell'AI — il modo in cui la tecnologia può aiutare a disinformare, molestare, generare spam ed essere utilizzata male da persone che non ne comprendono i limiti — sono già abbastanza preoccupanti.

Ma un rischio esistenziale dell'intelligenza artificiale è sicuramente legittimo: l'AI rappresenta un pericolo chiaro e presente per... l'AI.

Questa preoccupazione viene solitamente chiamata "model collapse" ed ha ricevuto una forte dimostrazione empirica in Shumailov et al. (2023) e Alemohammad et al. (2023). L'idea è semplice: se addestri modelli di AI da dati generati dall'AI, e poi prendi l'AI risultante e usi il suo output per addestrare un altro modello, ripetendo il processo per più generazioni, l'AI diventerà oggettivamente sempre peggiore. È come fare una fotocopia di una fotocopia di una fotocopia.

Recentemente c'è stata qualche discussione sul model collapse, e stanno apparendo titoli sulla stampa riguardo all'AI che sta esaurendo i dati. Se Internet si riempirà di dati generati dall'AI, e i dati creati dall'uomo diventeranno più difficili da identificare e utilizzare, allora, prima o poi, i modelli di AI raggiungeranno un limite qualitativo.

Allo stesso tempo, c'è un crescente utilizzo di tecniche di dati sintetici e model distillation nello sviluppo dell'AI. Entrambe consistono nell'addestrare modelli di AI almeno in parte sull'output di altri modelli di AI. Queste due tendenze sembrano contraddirsi a vicenda.

Le cose sono un po' più complicate di così. L'AI generativa intaserà il sistema e soffocherà il proprio progresso? O l'AI ci aiuterà a creare una migliore AI? O entrambe le cose?

Cercheremo di trovare alcune risposte in questo articolo.

tagModel Collapse

Per quanto apprezziamo Alemohammad et al. per aver inventato il termine "Model Autophagy Disorder (MAD)", "model collapse" è molto più accattivante e non coinvolge parole greche per l'auto-cannibalismo. La metafora del fare fotocopie di fotocopie comunica il problema in termini semplici, ma c'è qualcosa di più nella teoria sottostante.

Addestrare un modello di AI è un tipo di modellazione statistica, un'estensione di ciò che statistici e data scientist fanno da molto tempo. Ma, il primo giorno del corso di data science, si impara il motto del data scientist:

Tutti i modelli sono sbagliati, ma alcuni sono utili.

Questa citazione, attribuita a George Box, è la luce rossa lampeggiante che dovrebbe essere sopra ogni modello di AI. Si può sempre creare un modello statistico per qualsiasi dato, e quel modello darà sempre una risposta, ma assolutamente nulla garantisce che quella risposta sia giusta o anche solo vicina alla verità.

Un modello statistico è un'approssimazione di qualcosa. I suoi output possono essere utili, potrebbero persino essere abbastanza buoni, ma sono comunque approssimazioni. Anche se si ha un modello ben validato che, in media, è molto accurato, può e probabilmente farà ancora grandi errori a volte.

I modelli di AI ereditano tutti i problemi della modellazione statistica. Chiunque abbia giocato con ChatGPT o qualsiasi altro grande modello di AI ha visto i suoi errori.

Quindi, se un modello di AI è un'approssimazione di qualcosa di reale, un modello di AI addestrato sull'output di un altro modello di AI è un'approssimazione di un'approssimazione. Gli errori si accumulano, e intrinsecamente deve essere un modello meno corretto rispetto al modello da cui è stato addestrato.

Alemohammad et al. dimostrano che non si può risolvere il problema aggiungendo alcuni dei dati di addestramento originali all'output dell'AI prima di addestrare il nuovo modello "figlio". Questo rallenta solo il model collapse, non può fermarlo. A meno che non si introducano sufficienti dati nuovi, mai visti prima, del mondo reale durante l'addestramento con l'output dell'AI, il model collapse è inevitabile.

Quanti nuovi dati siano sufficienti dipende da fattori difficili da prevedere e specifici per ogni caso, ma più dati nuovi e reali e meno dati generati dall'AI è sempre meglio del contrario.

E questo è un problema perché tutte le fonti facilmente accessibili di nuovi dati creati dall'uomo sono già esaurite mentre la quantità di dati di immagini e testi generati dall'AI là fuori sta crescendo a passi da gigante. Il rapporto tra contenuti creati dall'uomo e contenuti creati dall'AI su Internet sta diminuendo, forse rapidamente. Non esiste un modo affidabile per rilevare automaticamente i dati generati dall'AI e molti ricercatori credono che non possa esisterne uno. L'accesso pubblico ai modelli di generazione di immagini e testi AI assicura che questo problema crescerà, probabilmente in modo drammatico, e non ha una soluzione ovvia.

La quantità di traduzioni automatiche su Internet potrebbe significare che è già troppo tardi. Il testo tradotto automaticamente su Internet ha inquinato le nostre fonti di dati per anni, molto prima della rivoluzione dell'AI generativa. Secondo Thompson, et al., 2024, possibilmente metà del testo su Internet potrebbe essere tradotto da un'altra lingua, e una grandissima parte di queste traduzioni è di scarsa qualità e mostra segni di generazione automatica. Questo può distorcere un modello linguistico addestrato su tali dati.

Come esempio, di seguito è riportato uno screenshot di una pagina del sito web Die Welt der Habsburger che mostra chiari segni di traduzione automatica. "Hamster buying" è una traduzione troppo letterale della parola tedesca hamstern, che significa fare scorta o acquisti dettati dal panico. Troppe istanze di questo tipo porteranno un modello AI a pensare che "hamster buying" sia una cosa reale in inglese e che il tedesco hamstern abbia qualcosa a che fare con i criceti domestici.

In quasi tutti i casi, avere più output AI nei dati di addestramento è negativo. Il quasi è importante, e discuteremo due eccezioni qui sotto.

tagDati Sintetici

I dati sintetici sono dati di addestramento o valutazione dell'AI che sono stati generati artificialmente invece che trovati nel mondo reale. Nikolenko (2021) fa risalire i dati sintetici ai primi progetti di computer vision negli anni '60 e ne delinea la storia come elemento importante di quel campo.

Ci sono molte ragioni per utilizzare dati sintetici. Una delle più importanti è combattere il bias.

I modelli linguistici di grandi dimensioni e i generatori di immagini hanno ricevuto molte critiche di alto profilo riguardo al bias. La parola bias ha un significato rigoroso in statistica, ma queste critiche spesso riflettono considerazioni morali, sociali e politiche che non hanno una semplice forma matematica o soluzione ingegneristica.

Il bias che non si vede facilmente è molto più dannoso e molto più difficile da correggere. I modelli che l'AI impara a replicare sono quelli visti nei suoi dati di addestramento, e dove questi dati hanno carenze sistematiche, il bias è una conseguenza inevitabile. Più cose diverse ci aspettiamo che l'AI faccia — più diversi sono gli input al modello — più possibilità ci sono che commetta errori perché non ha mai visto abbastanza casi simili nel suo addestramento.

Il ruolo principale dei dati sintetici nell'addestramento dell'AI oggi è garantire che ci siano abbastanza esempi di certi tipi di situazioni nei dati di addestramento, situazioni che potrebbero non essere sufficientemente presenti nei dati naturali disponibili.

Di seguito è riportata un'immagine che MidJourney ha prodotto quando sollecitato con "doctor": quattro uomini, tre bianchi, tre in camici bianchi con stetoscopi, e uno decisamente anziano. Questo non riflette la reale razza, età, genere o abbigliamento dei veri medici nella maggior parte dei paesi e contesti, ma probabilmente riflette le immagini etichettate che si trovano su Internet.

Quando sollecitato di nuovo, ha prodotto una donna e tre uomini, tutti bianchi, anche se uno è un cartone animato. L'AI può essere strana.

Questa particolare fonte di bias è una di quelle che i generatori di immagini AI hanno cercato di prevenire, quindi non otteniamo più risultati così chiaramente distorti come forse un anno fa dagli stessi sistemi. Un bias è visibilmente ancora presente, ma non è ovvio come dovrebbe apparire un risultato privo di bias.

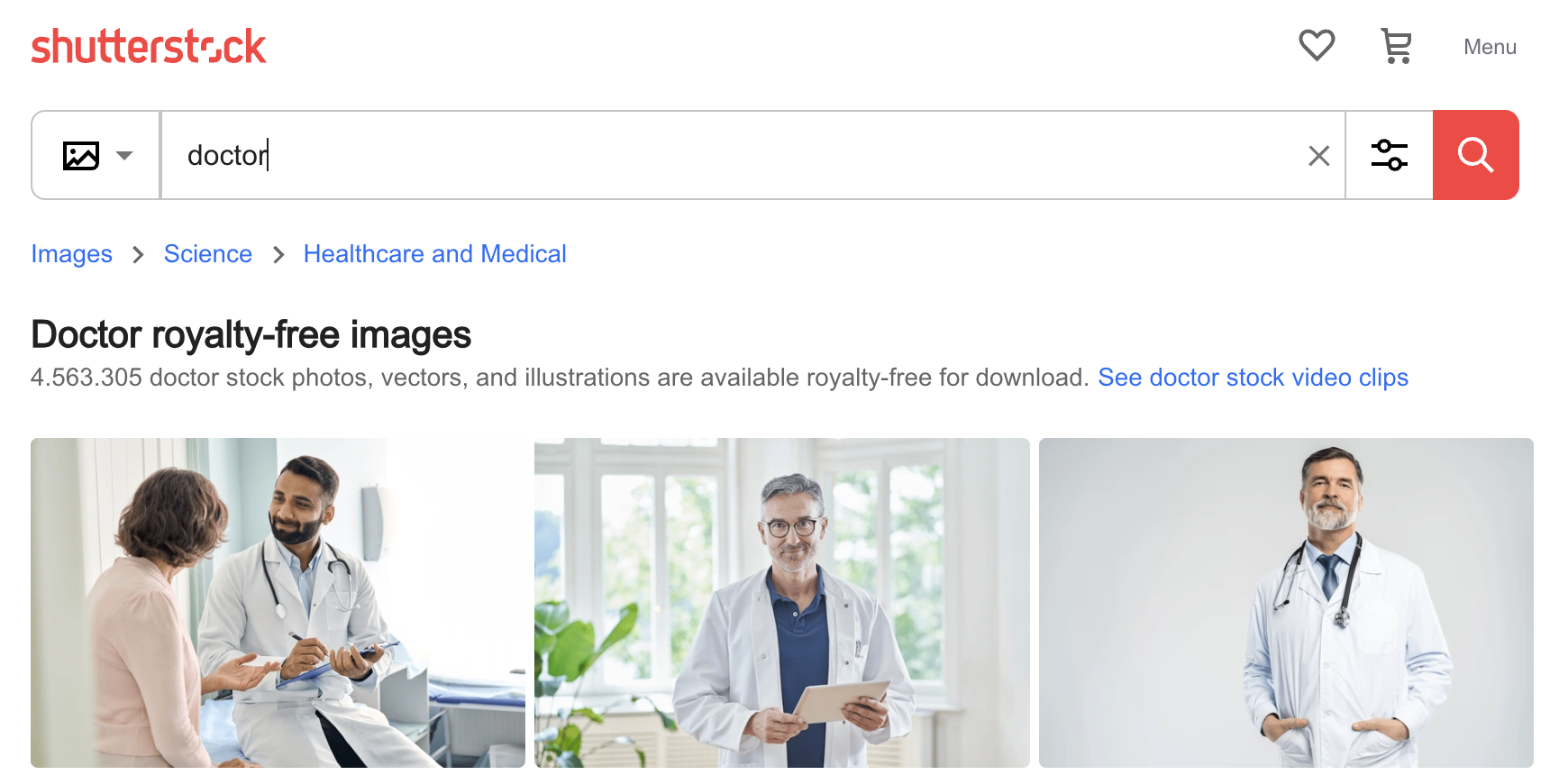

Tuttavia, non è difficile capire come un'AI possa acquisire questi tipi di pregiudizi. Di seguito sono riportate le prime tre immagini trovate per "doctor" sul sito di foto Shutterstock: Tre uomini, due più anziani e bianchi. I bias dell'AI sono i bias del suo addestramento, e se si addestrano modelli utilizzando dati non curati, si troveranno sempre questi tipi di bias.

Un modo per mitigare questo problema è utilizzare un generatore di immagini AI per creare immagini di medici più giovani, donne medico, medici che sono persone di colore e medici che indossano camici, completi o altri indumenti, e poi includerli nell'addestramento. I dati sintetici utilizzati in questo modo possono migliorare le prestazioni del modello AI, almeno rispetto a qualche norma esterna, invece di portare al collasso del modello. Tuttavia, distorcere artificialmente le distribuzioni dei dati di addestramento può creare effetti collaterali indesiderati, come Google ha recentemente scoperto.

tagDistillazione del Modello

La distillazione del modello è una tecnica per addestrare un modello direttamente da un altro. Un modello generativo addestrato — l'"insegnante" — crea tanti dati quanti ne servono per addestrare un modello "studente" non addestrato o meno addestrato.

Come ci si aspetterebbe, il modello "studente" non può mai essere migliore dell'"insegnante". A prima vista, ha poco senso addestrare un modello in questo modo, ma ci sono dei vantaggi. Il principale è che il modello "studente" può essere molto più piccolo, veloce o efficiente dell'"insegnante", pur approssimandone da vicino le prestazioni.

La relazione tra dimensione del modello, dati di addestramento e prestazioni finali è complicata. Tuttavia, in generale, a parità di condizioni:

- Un modello più grande ha prestazioni migliori di uno piccolo.

- Un modello addestrato con più dati o dati migliori (o almeno dati di addestramento più diversificati) ha prestazioni migliori di uno addestrato con meno dati o dati di qualità inferiore.

Questo significa che un modello piccolo può, a volte, avere prestazioni pari a quelle di uno grande. Per esempio, jina-embeddings-v2-base-en supera significativamente molti modelli molto più grandi nei benchmark standard:

| Model | Size in parameters | MTEB average score |

|---|---|---|

| jina-embeddings-v2-base-en | 137M | 60.38 |

multilingual-e5-base |

278M | 59.45 |

sentence-t5-xl |

1240M | 57.87 |

| Model | BEIR Score | Parameter count | |

|---|---|---|---|

| jina-reranker-v1-base-en | 52.45 | 137M | |

| Distilled | jina-reranker-v1-turbo-en | 49.60 | 38M |

| Distilled | jina-reranker-v1-tiny-en | 48.54 | 33M |

mxbai-rerank-base-v1 |

49.19 | 184M | |

mxbai-rerank-xsmall-v1 |

48.80 | 71M | |

bge-reranker-base |

47.89 | 278M |