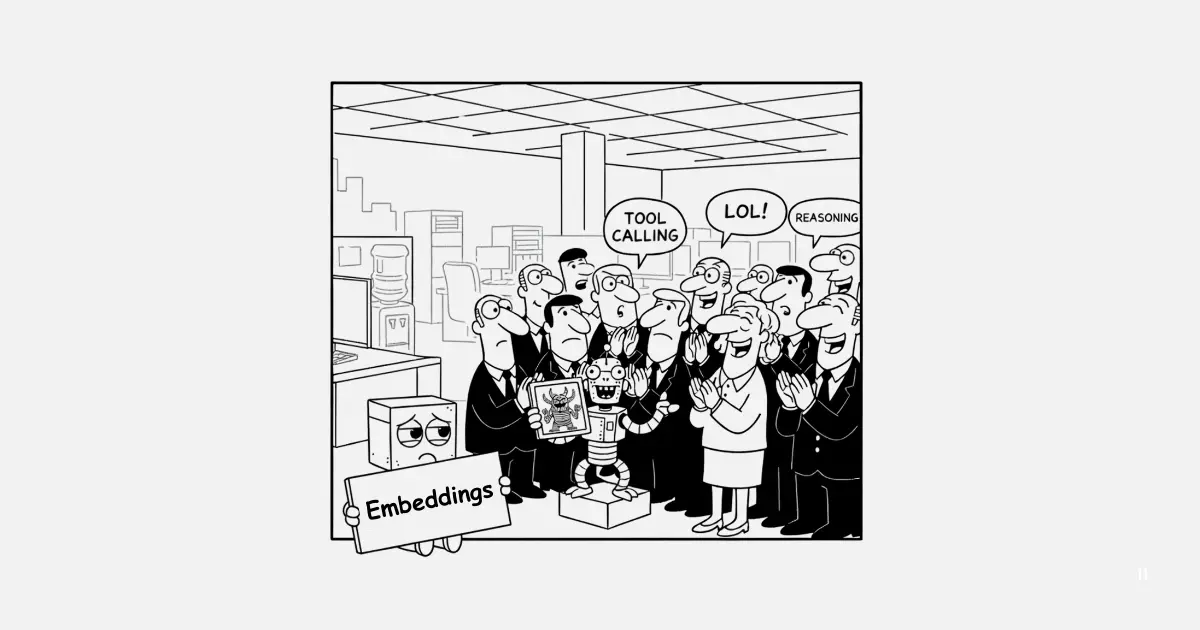

向量模型是 AI 界的私生子。它不像圖像生成那樣性感,也不像大模型聊天機器人那樣引人注目,更不像人工超智能的預測那樣末日感十足,語義向量模型是深奧且技術性的,一般消費者對它們沒有太多的直接用途。

向量模型是將語義轉換為高維空間中的幾何關係的向量。但試著跟不使用它們的人說說看,你會看到他們的眼睛因無聊而變得茫然。

這並不意味著它們不重要,甚至不具有革命性。將文本的語義表示為高維空間中的向量自 1950 年代以來就已存在,但具有 Transformer 架構的神經網路已將其擴展到語音、圖像、影片以及幾乎所有類型的數位資料。過去十年中計算語義的質的提升是轉變性的,並且對搜尋引擎、推薦演算法、自動分類器和決策系統的影響是巨大的,即使它們很少成為新聞。

在這場未被充分報導的革命中,一個被忽略的事情是,大多數神經網路,包括最近基於 Transformer 的神經網路,都隱含地是向量模型。大型語言模型、生成圖像模型和機器翻譯系統都透過將其輸入轉換為保留其基本語義的高維向量空間(即建立向量模型),然後使用它來產生輸出。這些模型可以很容易地被重新用於生成信息檢索和其他用途的向量模型。

在本文中,我們將討論使用生成語言模型(例如,大模型)來產生文本向量模型所涉及的主要問題,以及我們如何使用這項工作來改進我們的模型。

tag編碼器和解碼器

「編碼器」和「解碼器」這兩個術語在 AI 模型開發中經常被使用,但通常以非常令人困惑的方式使用。這些術語與電機工程和信息理論中的概念相關,可以追溯到神經網路更多是理論而非實踐的時代。

在其最初的概念中,編碼器將其輸入轉換為機器可用的形式,而解碼器則相反,將數據轉換為對人類更有用的東西。如果這看起來非常抽象,那是因為它確實如此。為了幫助理解,讓我們看一些具體的例子。

在傳統的數位電子產品(非 AI)中,編碼器是一種將豐富的輸入源(例如,麥克風捕獲的模擬聲音)轉換為二進制序列的設備,該二進制序列可以儲存在電腦記憶體中、物理數位媒體上,或透過像互聯網這樣的數位網路傳輸。

許多導致向量模型和生成式 AI 的早期工作都在機器翻譯中,其基本架構與此圖非常吻合。

您可以將向量模型視為編碼器-解碼器機器翻譯模型的「編碼器」一半,並添加了一個用於產生向量模型的轉接器。

您可以將生成模型視為僅是「解碼器」的一半:

以這種方式思考神經網路模型可能非常違反直覺。數據建模、語義和壓縮之間的關係是複雜且非常抽象的,但它對於我們如何理解 AI 模型非常重要。編碼器和解碼器模型之間的差異在於它們的使用方式,而不是它們的架構。

tag基於 Transformer 的編碼器和解碼器是相同的

編碼器和解碼器是相當抽象的概念,但如果我們談論的是基於 Transformer 的模型,它們都具有幾乎相同的架構。

下面的例子是指示性的生成語言模型和文本向量模型,但經過一些小的更改,同樣的事情也適用於其他媒體類型。

僅編碼器和僅解碼器模型都將文本作為輸入,並應用詞元化,然後進行向量化 — 本質上是在字典中查找詞元並為每個詞元替換適當的向量 — 然後根據需要添加填充。結果是模型其餘部分的固定長度輸入向量。

在僅解碼器的生成語言模型中,此輸入向量被傳遞到 Transformer 模型,然後傳遞到解碼器轉接器,該轉接器將其輸出轉換為一個或多個詞元。然後,文本生成模型將這些新詞元附加到輸入並再次運行以添加更多詞元。

除了編碼器設備產生向量模型而不是解碼器設備產生詞元之外,幾乎所有這些圖片都與基於 Transformer 的文本向量模型架構共享。

兩者之間的主要區別本質上不是架構上的;它們在於它們的訓練和使用方式。

生成語言模型通常是單向的(或「因果」的):它們僅透過查看前一個詞元來生成下一個詞元。向量模型通常是雙向的(或「非因果」的)。

這會影響它們的訓練方式。生成模型訓練反映了這一點,它透過從一次傳遞給它一個詞元的文本量中學習。向量模型通常使用「遮罩語言建模」(MLM)技術進行預訓練,這意味著它們會查看間隙前後的單詞以生成缺失單詞的語義表示。

儘管如此,原則上,將生成式大模型轉換為向量模型僅意味著用編碼器替換解碼器設備,並針對新用途對其進行微調。

那麼我們為什麼不這樣做呢?

tag基於 Transformer 的編碼器和解碼器是不同的

研究人員提出了三個不將生成語言模型轉換為文本向量模型的主要原因,但每個原因最近都受到了質疑。

雙向(「非因果」)注意力比單向(「因果」)注意力更好。

自開創性的 BERT 模型以來,我們一直認為雙向注意力比單向注意力更好,僅僅是因為有更多的信息可用。該模型可以在其完整的上下文中看到詞元,而不僅僅是在前面的單詞的上下文中。

然而,最近的研究(Wang et al. 2023, Gisserot-Boukhlef et al. 2025)表明,雙向和單向預訓練之間的結果沒有太大差異,儘管根據您所關注的因素,每種方法都有一些小的優勢。

生成式大模型受到維度詛咒的影響,使其不擅長泛化。

大模型並非旨在成為良好的向量模型。它們的內部向量表示 — 隱藏層 — 通常比向量模型擁有的維度多得多。這些模型太大,它們可能無法泛化,因為大的語義空間不一定包含緊湊的表示。

這個問題有時被稱為維度詛咒,它困擾著神經網路。

與向量模型不同,生成式語言模型是按曲線評分的。生成式模型不直接使用那些內部向量模型,而是使用將它們轉換回詞元所產生的語言。如果模型看起來說話流利且連貫,我們會給予高評價。相比之下,向量模型有實際的任務要執行,需要正確的泛化。因此,維度詛咒對於生成式模型似乎不太重要,但對於向量模型來說卻是致命的。

然而,最近生成式語言模型已經擺脫了一些維度詛咒。具有少於 100 億參數的高性能生成式小模型(SLM)現在非常普遍,雖然它們的動機更多是為了擁有更小、更有效率的語言模型,而不是對向量模型有任何興趣,但我們仍然可以利用它們來構建更好的模型。

人們已經嘗試過了,但效果不太好。

向量模型和生成式模型的二元性並不新鮮,但從生成式模型改編而來的向量模型通常比性能相當的向量模型大得多。OpenAI 在 2022 年改編了 GPT-3 用於向量模型,但儘管它有大約 1750 億個參數,它的性能與參數少於 10 億的 MLM 訓練的向量模型大致相同。

然而,NVIDIA 從 70 億參數的 Mistral-7B SLM 改編而來的 NV-Embed 模型系列,已在標準向量模型基準測試中實現了最先進的性能。這足以證明改編生成式語言模型在實踐中可以很好地發揮作用。

tag改編生成式模型的好處

將解碼器風格的生成式語言模型重新用於編碼器風格的向量模型可能沒有缺點,但至少在紙面上似乎也沒有任何優點。但在實踐中,有一些明顯的好處。

首先,生成式語言模型是大量研究和資金的重點,因為它們是人工智慧中性感的領域。從它們改編而來的向量模型可以用很少的額外成本來利用額外的關注和努力。與用於優化預訓練模型的對比微調相比,從頭開始開發和訓練新的向量模型是一項昂貴的操作,因此這種純粹的經濟效益非常顯著。

例如,我們最近發布的模型 jina-code-embeddings-1.5b 和 jina-code-embeddings-0.5b 是第一個基於程式碼生成骨幹的程式碼向量模型,特別是 Qwen2.5-Coder-1.5B 和 Qwen2.5-Coder-0.5B。我們大大提高了它們的向量模型性能,因為我們能夠將所有的注意力集中在訓練它們以獲得良好的向量模型,而不是進行複雜且昂貴的預訓練。

其次,可以將生成式模型的能力轉移到新的領域。

jina-embeddings-v4 模型正是這樣做的。它改編了 Qwen2.5-VL-3B-Instruct,一個 38 億參數的視覺語言模型,用於多模態向量模型。它作為圖表、螢幕截圖和其他視覺文檔圖像輸入的向量模型的卓越性能依賴於生成式模型預先存在的自然語言理解能力。我們沒有從頭開始訓練模型,首先理解語言,然後解析圖像中的印刷文本,最後產生良好的向量模型,而是能夠從現有的圖像向量模型和生成式語言模型中轉移知識,而是專注於向量模型任務的對比訓練。

tag向量模型完成工作

在所有條件相同的情況下,使用生成式語言模型作為向量模型骨幹並沒有明顯的優勢。如果您必須從頭開始構建文本向量模型,那麼使用雙向或單向預訓練似乎沒有太大區別。投資於數據品質、任務專業化和向量模型品質的微調更重要。

但所有條件都不相同。

向量模型獲得的資金遠不及生成式語言模型,而使用它們的模型作為我們的骨幹讓我們能夠投入更多的精力來製作更好的向量模型,因為它們將資源投入到預訓練中。

向量模型面臨特殊的問題,因為它們沒有生成式人工智慧聞名遐邇的令人印象深刻的演示。相反,它們在準確性、品質和成本至關重要的重要且真實存在的用例中發揮作用。資訊檢索、分類任務、推薦系統、垃圾郵件和欺詐檢測以及內容審核——所有這些都是向量模型現在正在執行的實際工作。

向量模型並不那麼性感,但它們確實完成了工作。因此,如果我們可以將一些資金更充足的工作從人工智慧性感的一面重新分配給它不受歡迎的繼子,這似乎是公平的。